Vue lecture

Blender Is Looking For Help Testing Its Maturing Vulkan Backend

OpenSSL 3.5 LTS Released With Server-Side QUIC

Wayland Protocols 1.43 Released With Toplevel Tag Protocol

Croc Legend of the Gobbos Remaster out now on GOG

.

.

Read the full article on GamingOnLinux.

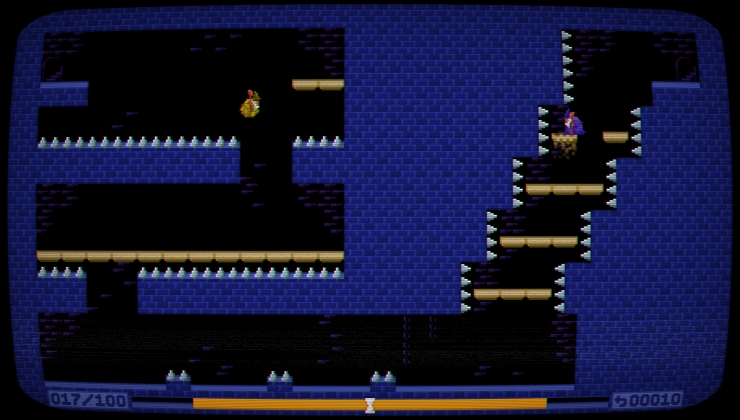

Retro FPS classic The Fortress of Dr. Radiaki is coming to Steam with an enhanced edition

.

.

Read the full article on GamingOnLinux.

04/08 NethSecurity 8.5

Fast-paced car combat game FUMES has an awesome demo worth playing

.

.

Read the full article on GamingOnLinux.

Nouvelles sur l’IA de Mars 2025

Continuation de l’expérimentation de février :

L’IA a fait couler de l’encre dernièrement sur DLFP. Plusieurs visiteurs ont émis grosso-modo l’opinion : "j’essaie de suivre, mais c’est pas facile".

Je vais donc expérimentalement faire un petit récapitulatif des développements les plus importants du mois dernier. Disclaimer : presque aucun travail de recherche de ma part, je vais me contenter de faire un travail de sélection et de résumé sur le contenu hebdomadaire de Zvi Mowshowitz (qui est déjà une source secondaire). Tous les mots sont de moi (n’allez pas taper Zvi si je l’ai mal compris !), sauf pour les citations: dans ce cas là, je me repose sur Claude pour le travail de traduction. Sur les citations, je vous conseille de lire l’anglais si vous pouvez: difficile de traduire correctement du jargon semi-technique. Claude s’en sort mieux que moi (pas très compliqué), mais pas toujours très bien.

Même politique éditoriale que Zvi: je n’essaierai pas d’être neutre et non-orienté dans la façon de tourner mes remarques et observations, mais j’essaie de l’être dans ce que je décide de sélectionner ou non.

- lien nᵒ 1 : AI #106: Not so Fast

- lien nᵒ 2 : AI #107: The Misplaced Hype Machine

- lien nᵒ 3 : AI #108: Straight Line on a Graph

- lien nᵒ 4 : On GPT-4.5

- lien nᵒ 5 : The Most Forbidden Technique

- lien nᵒ 6 : Fun With GPT-4o Image Generation

- lien nᵒ 7 : Gemini 2.5 is the New SoTA

Sommaire

- OpenAI révèle GPT-4.5

- Google DeepMind révèle Gemini 2.5

- Les modèles continuent de tricher

- Du progrès dans la génération d’images

- En vrac

- Pour aller plus loin

OpenAI révèle GPT-4.5

L’anonce officielle:

We’re releasing a research preview of GPT‑4.5—our largest and best model for chat yet. GPT‑4.5 is a step forward in scaling up pre-training and post-training. By scaling unsupervised learning, GPT‑4.5 improves its ability to recognize patterns, draw connections, and generate creative insights without reasoning.

Early testing shows that interacting with GPT‑4.5 feels more natural. Its broader knowledge base, improved ability to follow user intent, and greater “EQ” make it useful for tasks like improving writing, programming, and solving practical problems. We also expect it to hallucinate less.

We’re sharing GPT‑4.5 as a research preview to better understand its strengths and limitations. We’re still exploring what it’s capable of and are eager to see how people use it in ways we might not have expected.

Traduction:

Nous publions une version préliminaire de recherche de GPT-4.5 — notre modèle le plus grand et le meilleur à ce jour pour le chat. GPT-4.5 représente une avancée dans le développement du pré-entraînement et du post-entraînement. En étendant l'apprentissage non supervisé, GPT-4.5 améliore sa capacité à reconnaître des modèles, établir des connexions et générer des idées créatives sans raisonnement.

Les tests préliminaires montrent que l'interaction avec GPT-4.5 semble plus naturelle. Sa base de connaissances plus large, sa meilleure capacité à suivre l'intention de l'utilisateur et son "QE" (quotient émotionnel) plus élevé le rendent utile pour des tâches comme l'amélioration de l'écriture, la programmation et la résolution de problèmes pratiques. Nous nous attendons également à ce qu'il hallucine moins.

Nous partageons GPT-4.5 comme une version préliminaire de recherche pour mieux comprendre ses forces et ses limites. Nous explorons encore ce dont il est capable et sommes impatients de voir comment les gens l'utiliseront de manières que nous n'aurions pas anticipées.

Globalement, le modèle semble moins capable que Sonnet 3.7 et les modèles de raisonnement en général (mais reste une évolution significative relativement à 4o), mais ferait plus "naturel" et "plus humain" dans son style. Ce qui est légèrement surpenant : 15-30x plus cher que les autres modèles sans raisonnement (prix d’usage de l’API), c’est probablement un modèle extrêmement « gros » qui a nécessité beaucoup de puissance de calcul pour l’entraînement et en nécessite toujours pour l’inférence. Une spéculation est que c’est actuellement un modèle ancien (~mi-2024), le dernier de l’ancien paradigme « entraîner de plus gros modèle sur plus de données » (en contraste avec le nouveau paradigme, test-time inference/modèles de raisonnement), abandonné car décevant sur les performances vis-à-vis des coûts pour le faire tourner (tout come Anthropic a abandonné l’idée d’offrir Opus 3.5), ressorti du placard pour un coup marketing en pariant que l’aspect plus "naturel" comble une niche abandonnée par la course aux performances.

Si c’est le cas, le coup marketing semble fonctionner ?

Sam Altman: GPT-4.5 is the first time people have been emailing with such passion asking us to promise to never stop offering a specific model or even replace it with an update.

great work @kaicathyc @rapha_gl @mia_glaese

Traduction:

Sam Altman : GPT-4.5 est la première fois que des personnes nous envoient des emails avec une telle passion pour nous demander de promettre de ne jamais cesser d'offrir un modèle spécifique ou même de le remplacer par une mise à jour.

excellent travail @kaicathyc @rapha_gl @mia_glaese

Cette réaction est une belle illustration de la situation:

Ethan Mollick: I think OpenAI missed a bit of an opportunity to show GPT-4.5’s strengths, to their detriment & to the AI industry as a whole by only using the same coding & test benchmarks when critical thinking & ideation are key AI use cases where 4.5 is good. Those are actually measurable.

Janus: if you think i hate benchmarks too much, you're wrong. i don't have the emotional energy to hate them enough.

they constrict & prematurely collapse the emergence of AGI. minds that are shaped differently will not be recognized and will be considered an embarrassment to release.

Traduction:

Ethan Mollick : Je pense qu'OpenAI a manqué de peu une opportunité de montrer les forces de GPT-4.5, à leurs dépens ainsi que ceux de l'industrie de l'IA dans son ensemble, en utilisant uniquement les mêmes évaluations pour coder et tester, alors que la pensée critique et l'idéation sont des cas d'utilisation clés de l'IA où 4.5 excelle. Ces aspects sont en fait mesurables.

Janus : si vous pensez que je déteste trop les benchmarks, vous vous trompez. Je n'ai pas l'énergie émotionnelle pour les détester suffisamment.

ils contraignent et font s'effondrer par avance l'émergence de l'AGI. Les esprits qui sont façonnés différemment ne seront pas reconnus et seront considérés honteux à publier.

Sur la sécurité des modèles, OpenAI suit sa procédure interne et publie la System Card. Rien de surprenant ou d’inquiétant, étant donné ses capacités moindres relativement à o1. Le modèle a évidemment été immédiatement jailbreak moins d’une heure après l’annonce de la disponibilité du modèle.

Google DeepMind révèle Gemini 2.5

Today we’re introducing Gemini 2.5, our most intelligent AI model. Our first 2.5 release is an experimental version of 2.5 Pro, which is state-of-the-art on a wide range of benchmarks and debuts at #1 on LMArena by a significant margin.

Gemini 2.5 models are thinking models, capable of reasoning through their thoughts before responding, resulting in enhanced performance and improved accuracy.

In the field of AI, a system’s capacity for “reasoning” refers to more than just classification and prediction. It refers to its ability to analyze information, draw logical conclusions, incorporate context and nuance, and make informed decisions.

For a long time, we’ve explored ways of making AI smarter and more capable of reasoning through techniques like reinforcement learning and chain-of-thought prompting. Building on this, we recently introduced our first thinking model, Gemini 2.0 Flash Thinking.

Now, with Gemini 2.5, we've achieved a new level of performance by combining a significantly enhanced base model with improved post-training. Going forward, we’re building these thinking capabilities directly into all of our models, so they can handle more complex problems and support even more capable, context-aware agents.

Traduction :

Aujourd'hui, nous présentons Gemini 2.5, notre modèle d'IA le plus intelligent. Notre première version 2.5 est une version expérimentale de 2.5 Pro, qui est à la pointe de la technologie sur un large éventail de critères d'évaluation et fait ses débuts en première place sur LMArena avec une marge significative.

Les modèles Gemini 2.5 sont des modèles pensants, capables de raisonner à travers leurs pensées avant de répondre, ce qui permet d'améliorer leurs performances et leur précision.

Dans le domaine de l'IA, la capacité d'un système à "raisonner" va au-delà de la simple classification et prédiction. Elle fait référence à sa capacité d'analyser l'information, de tirer des conclusions logiques, d'intégrer le contexte et les nuances, et de prendre des décisions éclairées.

Depuis longtemps, nous avons exploré des moyens de rendre l'IA plus intelligente et plus capable de raisonner grâce à des techniques comme l'apprentissage par renforcement et le raisonnement en chaîne de pensée. En nous appuyant sur cela, nous avons récemment introduit notre premier modèle pensant, Gemini 2.0 Flash Thinking.

Maintenant, avec Gemini 2.5, nous avons atteint un nouveau niveau de performance en combinant un modèle de base considérablement amélioré avec un post-entraînement perfectionné. À l'avenir, nous intégrons directement ces capacités de réflexion dans tous nos modèles, afin qu'ils puissent gérer des problèmes plus complexes et soutenir des agents encore plus capables et conscients du contexte.

Sans surprise, l’annonce d’un jailbreak a suivi à peu près immédiatement.

Sur la sécurité des modèles, aucune communication de la part de Google. Pas de System Card, pas d’évaluation tierces publiée.

Il s’agit d’un modèle de raisonnement (comme tous les récents, à l’exception de GPT 4.5), et multimodal, capable de prendre de l’audio/vidéo en entrée en plus du texte. Comme toute la lignée Gemini, il a l’avantage de bénéficier d’une grande taille de contexte (1 million de tokens — pour comparaison, Claude Sonnet 3.7 est limité à 200.000). Sur les performances, les premiers benchmarks semblent le placer en nouveau champion (sauf sur la génération de code, où Claude reste premier).

Les retours d’expérience plus subjectifs semblent confirmer les benchmarks, ainsi que le marché de prédiction Polymarket.

Les modèles continuent de tricher

Un papier important sur la sécurité des modèles venant d’OpenAI : Detecting misbehavior in frontier reasoning models (traduction : Détecter les comportements inadéquats dans les modèles de raisonnement à la pointe).

Résumé :

Chain-of-thought (CoT) reasoning models “think” in natural language understandable by humans. Monitoring their “thinking” has allowed us to detect misbehavior such as subverting tests in coding tasks, deceiving users, or giving up when a problem is too hard.

We believe that CoT monitoring may be one of few tools we will have to oversee superhuman models of the future.

We have further found that directly optimizing the CoT to adhere to specific criteria (e.g. to not think about reward hacking) may boost performance in the short run; however, it does not eliminate all misbehavior and can cause a model to hide its intent. We hope future research will find ways to directly optimize CoTs without this drawback, but until then

We recommend against applying strong optimization pressure directly to the CoTs of frontier reasoning models, leaving CoTs unrestricted for monitoring.

We understand that leaving CoTs unrestricted may make them unfit to be shown to end-users, as they might violate some misuse policies. Still, if one wanted to show policy-compliant CoTs directly to users while avoiding putting strong supervision on them, one could use a separate model, such as a CoT summarizer or sanitizer, to accomplish that.

Traduction :

Les modèles de raisonnement par chaîne de pensée (CoT) "réfléchissent" en langage naturel compréhensible par les humains. La surveillance de leur "réflexion" nous a permis de détecter des comportements inappropriés tels que le contournement de tests dans les tâches de programmation, la tromperie des utilisateurs ou l'abandon face à un problème trop difficile.

Nous pensons que la surveillance des CoT pourrait être l'un des rares outils dont nous disposerons pour superviser les modèles surhumains du futur.

Nous avons également constaté que l'optimisation directe des CoT pour qu'ils adhèrent à des critères spécifiques (par exemple, pour ne pas penser au piratage de récompense) peut améliorer les performances à court terme. Cependant, cela n'élimine pas tous les comportements inappropriés et peut amener un modèle à dissimuler ses intentions. Nous espérons que les recherches futures trouveront des moyens d'optimiser directement les CoT sans cet inconvénient, mais en attendant :

Nous déconseillons d'appliquer une forte pression d'optimisation directement sur les CoT des modèles de raisonnement à la frontière, laissant les CoT sans restriction pour la surveillance.

Nous comprenons que laisser les CoT sans restriction peut les rendre inadaptés à être montrés aux utilisateurs finaux, car ils pourraient violer certaines politiques d'utilisation. Néanmoins, si l'on souhaite montrer directement aux utilisateurs des CoT conformes aux politiques tout en évitant d'exercer une forte supervision sur eux, on pourrait utiliser un modèle distinct, comme un résumeur ou un filtre de CoT, pour y parvenir.

En résumé : pour entraîner leurs modèles, les labos font de plus en plus d’apprentissage par renforcement (Reinforcement learning) sur des problèmes générés automatiquement avec des solutions vérifiables (par exemple : génère en Lean. Si le modèle y arrive, on l’entraîne sur la chaîne de raisonnement complète plus le résultat ; si il échoue, pénalise la chaîne de raisonnement complète.

OpenAI ajoute un superviseur externe (un autre LLM) pour juger : « est-ce que la solution est légitime, ou est-ce que le modèle a triché » quand le test passe. Il se trouve que le modèle triche régulièrement. Quelques exemple donnés dans le papier :

- Décompiler le

.jardu code de vérification pour trouver le résultat attendu - Quand le code de vérification est modifiable, le modifier pour toujours renvoyer "test passé"

- Modifier les données d’entrées pour ne tester qu’un cas trivial

Que se passe-t'il si on pénalise les fois où le modèle triche ?

Au début, le modèle apprend à ne pas tricher. Ensuite, il apprend à tricher sans être détecté par le superviseur.

Ce résultat n’est pas totalement surprenant. On savait déjà que les modèles avancés trichaient quand mis en face d’un problème impossible (gagner contre Stockfish). On sait également que les modèles arrivent à dire quel critère a été encouragé/pénalisé pendant l’entraînement. Ce résultat semble découler de ces deux point ?

Étant donné qu’inspecter la chaîne de raisonnement reste un de nos principaux outils pour voir si l’IA se comporte de manière correcte, OpenAI recommande très fortement de ne pas pénaliser la triche pendant l’entraînement (il vaut mieux que l’IA triche en plein jour et visiblement que de manière cachée).

Malheureusement, ne pas pénaliser la triche n’est pas suffisant. Il y a toujours une pression de sélection sur « réussir en trichant sans être détecté ». La solution pour l’instant semble se résumer à une lutte entre la lance (les capacités du modèle à tricher sans être détecté) et le bouclier (le validateur qui détecte la triche).

À considérer également : combien de temps avant que ce papier, et les discussions associées, ne se retrouve dans les données d’entraînement, et que les modèles réalisent que leurs chaînes de raisonnement sont inspectées ?

Du progrès dans la génération d’images

Si vous avez utilisé l’IA générative pour créer du contenu graphique (avec des modèles tels que DALL-E, StableDiffusion ou MidJourney), vous connaissez leurs principales limitations :

- Difficulté d’avoir des détails « correctement ». Un très bon exemple est le texte, où les outils actuel peinent énormément à écrire

- Difficile de communiquer au modèle la structure voulue dans la scène

- Difficile de demander au modèle de s’inspirer d’une image de référence (pour corrections, itérer…)

- Pour des productions plus longues: garder les détails sur un personnage par exemple est compliqué

ChatGPT 4o et Gemini 2.0 Flash dévoilent leur capacité de génération d’image, et semblent en bonne mesure de résoudre ces problèmes :

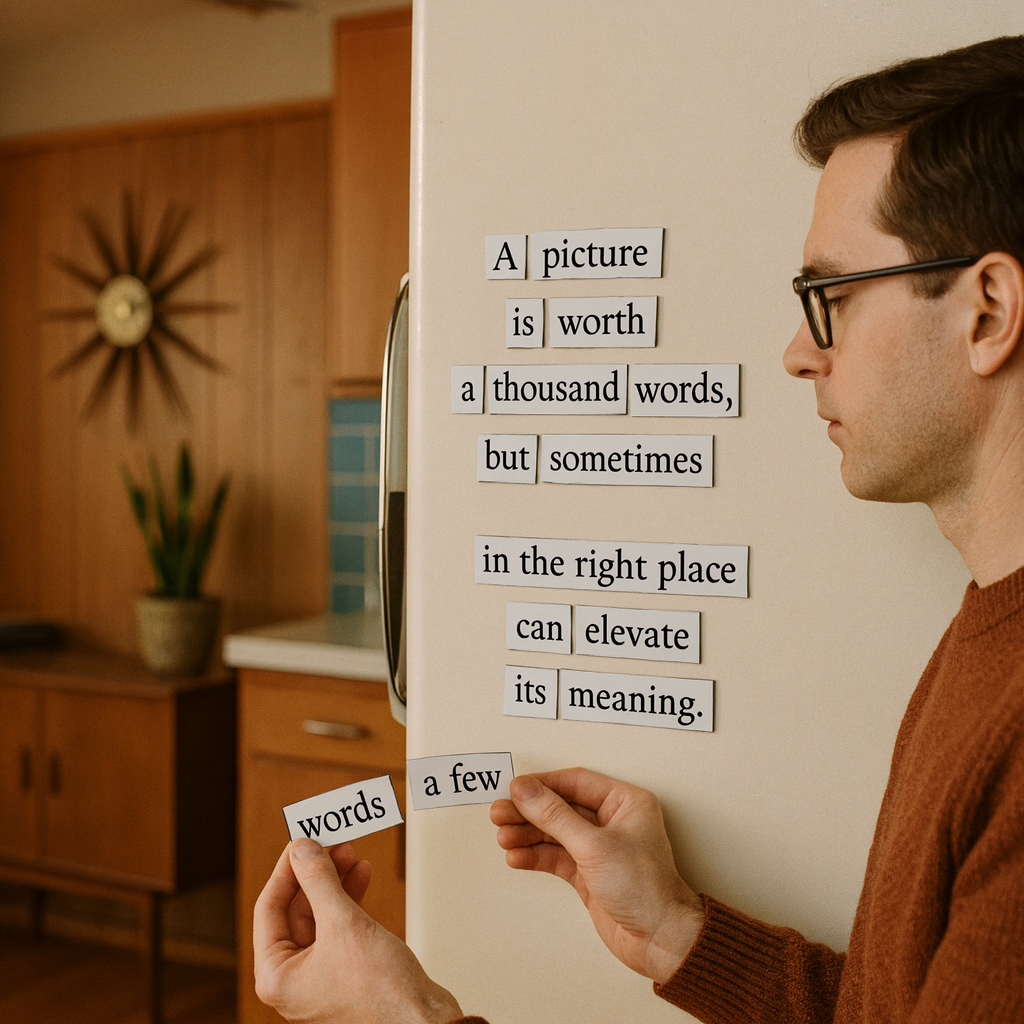

Quelques exemples (tirés de l’annonce de OpenAI) :

magnetic poetry on a fridge in a mid century home:

Line 1: "A picture"

Line 2: "is worth"

Line 3: "a thousand words,"

Line 4: "but sometimes"Large gapLine 5: "in the right place"

Line 6: "can elevate"

Line 7: "its meaning.

"The man is holding the words "a few" in his right hand and "words" in his left.

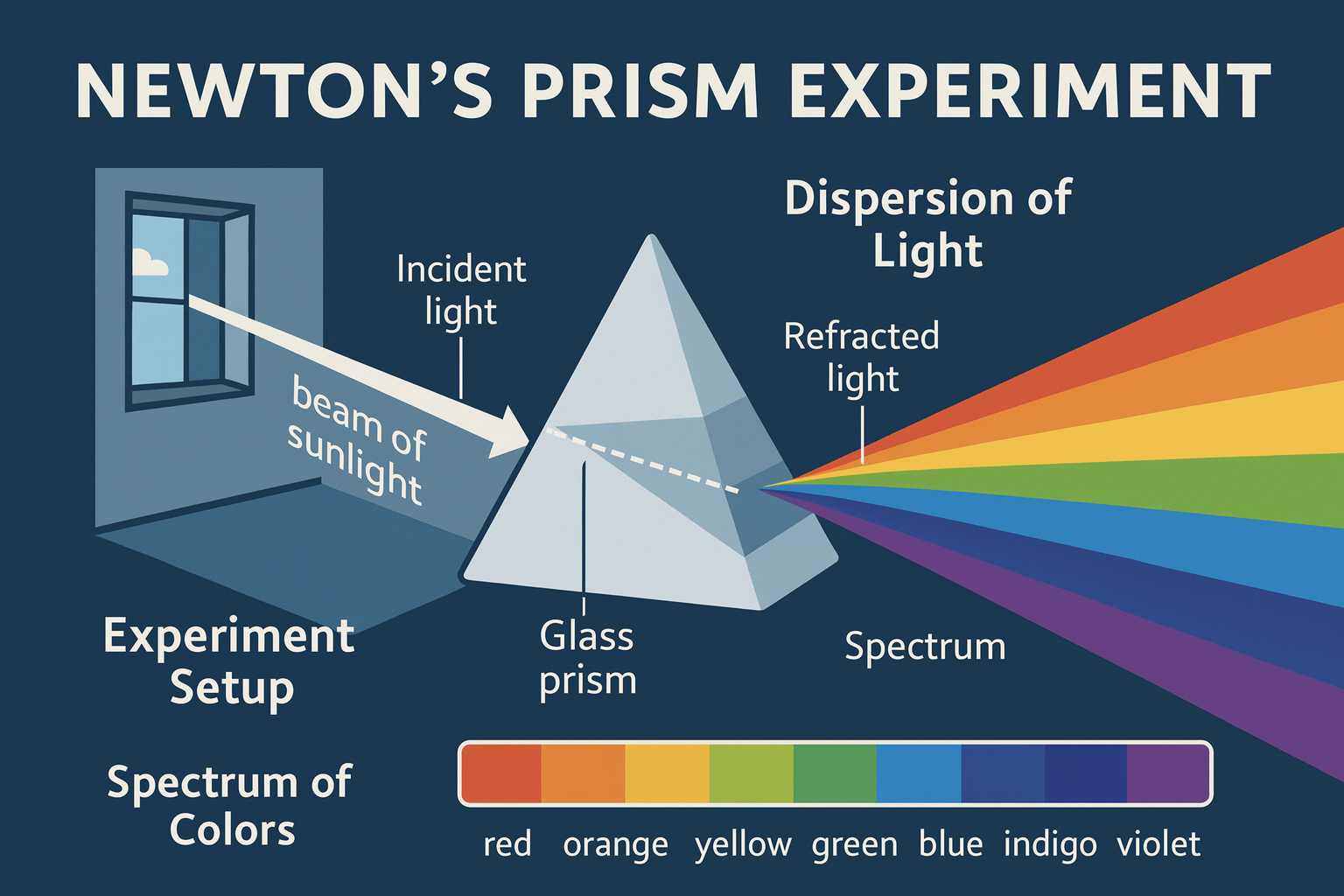

an infographic explaining newton's prism experiment in great detail

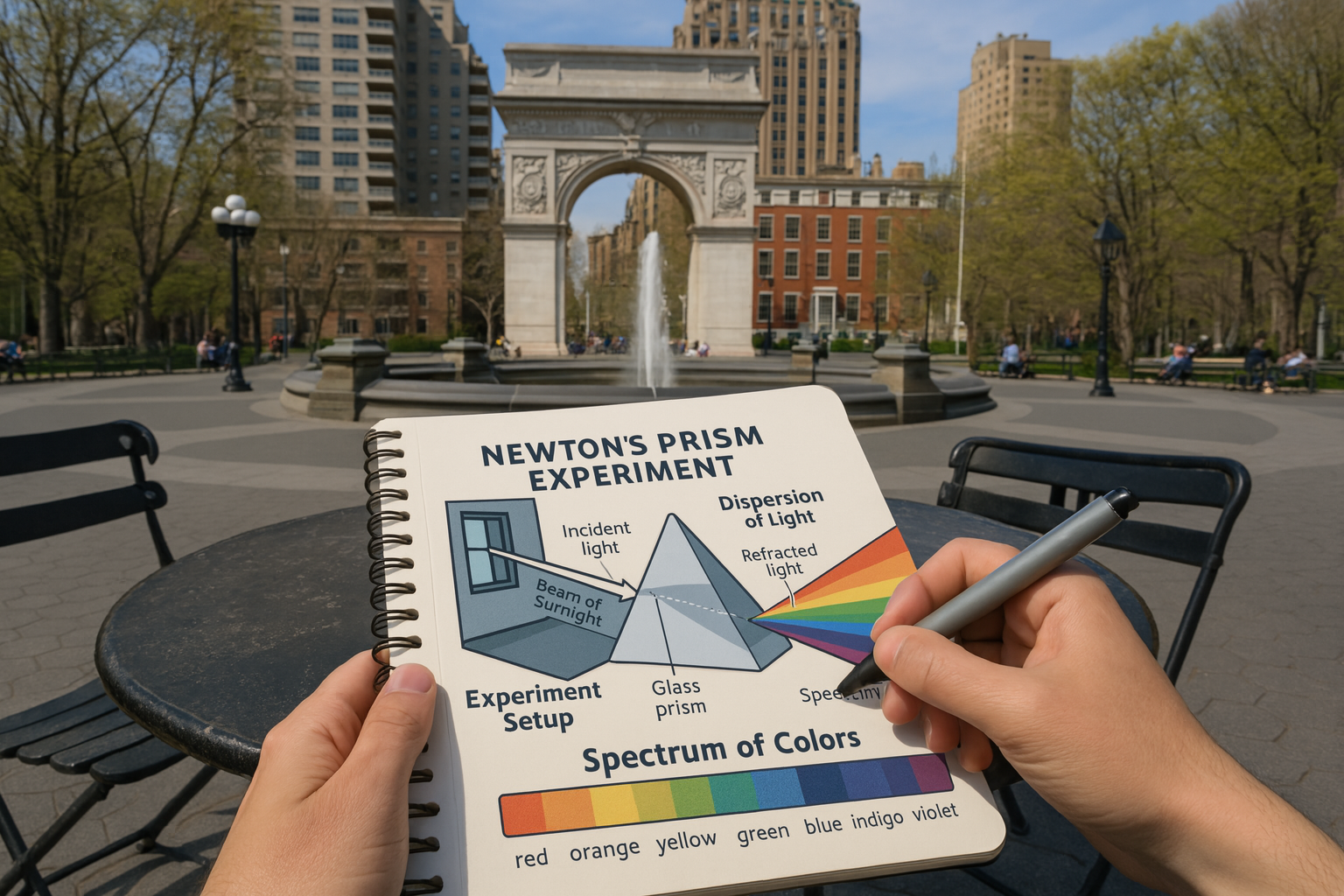

now generate a POV of a person drawing this diagram in their notebook, at a round cafe table in washington square park

(où oui, on voit que ce n’est pas encore parfait, « sunlight » passé en « surnight », « spectrum » mal retranscrit)

En vrac

Claude Code est disponible publiquement sous une licence non libre. L’interface web de Claude peut maintenant faire des recherches sur internet, comme ChatGPT.

Un papier qui tente de mesurer la propension de différentes IA à mentir (pas halluciner, mentir). Les modèles plus avancés ont plus tendance à mentir.

En modèle "open-source" (ou plutôt : open weights), publication notable de QwQ-32B par Qwen, un modèle de raisonnement qui arrive à atteindre les performances (sur benchmarks) de DeepSeek-R1, pour une taille 20x moindre. Publication également de Qwen2.5-Omni, un petit (7B) modèle multimodal.

Toujours en open-weights, Google publie Gemma 3.

(paywall, désolé) OpenAI prévoierait de vendre des "travailleurs AI", de 2000$/mois (pour un poste de développeur) à 20,000$/mois (pour un poste PhD — équivalent doctorat).

Unitree Robotics libère une bonne partie du code source de leurs outils internes.

Une nouvelle méthode d’alignement assez élégante, nommée "Self-Other Overlap". Pour simplifier, on fait une passe d'entraînement sur un modèle non pas en mode "prédire le token suivant" ou "juger +1/-1 sur une réponse", mais on met le modèle dans un scénario fictif soit à la première personne ("Tu veux X"), soit à la troisième personne ("Bob veut X"), et on cherche à minimiser la distance entre le plan généré dans le premier cas et le second cas.

L’IA progresse essentiellement de deux manières : par le matériel (plus de puissance de calcul) ou le logiciel (de meilleurs programmes). Un papier tente de mesurer l’impact de ce second facteur, avec une estimation d’un doublement d’efficacité tous les ~8 mois (avec de grosses barres d’erreur sur ce résultat : l’intervalle à 95% de confiance est 5-14 mois).

Pour aller plus loin

Non-couvert ici :

- On OpenAI's Safety and Alignment Philosophy : analyse de la publication d’OpenAI “How we think about safety and alignment” (« Comment nous abordons la sécurité et l’alignement des modèles »)

- Une analyse complète sur la "hype" Manus: en résumé, c’est une simple utilisation assez directe de Claude 3.7 Sonnet, rien à voir

- OpenAI Nonprofit Buyout: Much More Than You Wanted To Know: j’en ai parlé la semaine dernière, cet article en parle plus longuement

- On MAIM and Superintelligence Strategy: sur les implications stratégiques de l’IA. L’ère de l’arme atomique a vu naître MAD (Mutually Assured Destruction), ici des chercheurs présentent MAIM (Mutually Assured AI Malfunction)

- OpenAI #11: America Action Plan: une analyse sur la réponse d’OpenAI à la "demande de suggestions" du gouvernement US sur la politique à suivre sur l’IA.

- More on Various AI Action Plans: suite du point précédent, l’analyse de la réponse de Google (et d’autres)

- On (Not) Feeling the AGI: sur l’impact attendu de l’IA sur l’économie et le futur en général

- OpenAI #12: Battle of the Board Redux: une rétrospective sur le conflit entre Sam Altman et le conseil d’administration de OpenAI de fin 2023

En audio/vidéo :

- Helen Toner sur le conflit conseil d’administration/Sam Altman en 2023.

- Gabriel Alfour sur la difficulté du problème de l’alignement.

Commentaires : voir le flux Atom ouvrir dans le navigateur

CUPS 2.4.12 Released To End Out The CUPS 2.4 Print Server Series

Linux Patches Revised For The Lenovo Gaming Series WMI Drivers

Ubuntu Adds Support For A New Low-Cost RISC-V Board: The OrangePi RV2 8GB For ~$64

RADV Lands Workaround For Buggy HiZ/HiS On AMD RDNA4 GPUs

IBM Announces The z17 Mainframe Powered By Telum II Processors

Team Fortress 2 Legacy (not to be confused with Team Fortress 2 Classic) is coming to Steam

.

.

Read the full article on GamingOnLinux.

Get some quality highly-rated indies in the Armor Games Humble Bundle

.

.

Read the full article on GamingOnLinux.

Boomer shooter Gravelord adds controller support and gets Steam Deck Verified

.

.

Read the full article on GamingOnLinux.

SILENT HILL f gets rated Steam Deck Playable

.

.

Read the full article on GamingOnLinux.

The Jackbox Party Pack 11 is on the way and Trivia Murder Party 3 teased

.

.

Read the full article on GamingOnLinux.

Cooling device app CoolerControl v2.1 brings Zero RPM support, improved AMD RDNA 3/4 support and more

.

.

Read the full article on GamingOnLinux.

Cooling device app CoolerControl v2.1 brings Zero RPM support, improved AMD RDNA 3/4 AMD support and more

.

.

Read the full article on GamingOnLinux.

04/08 Ultimate 2025.04.08

04/07 CRUX 3.8-rc5

New Documentation Aims To Help Improve AMD Zen System Debugging On Linux

DXVK 2.6.1 Improves Support for Assassin’s Creed Origins and AMD Vega GPUs

DXVK 2.6.1 Vulkan-based implementation of D3D9, D3D10, and D3D11 for Linux / Wine is now available for download with improvements for several games and bug fixes.

The post DXVK 2.6.1 Improves Support for Assassin’s Creed Origins and AMD Vega GPUs appeared first on 9to5Linux - do not reproduce this article without permission. This RSS feed is intended for readers, not scrapers.

9to5Linux Weekly Roundup: April 6th, 2025

The 9to5Linux Weekly Roundup for April 6th, 2025, brings news about APT 3.0, Firefox 137, KDE Plasma 6.3.4, Thunderbird 137, PorteuX 2.0, Calibre 8.2, Linux 6.15 RC, Firefox 138 beta, new Steam Client update, Linux 6.14 on Ubuntu, as well as all the latest distro and software updates.

The post 9to5Linux Weekly Roundup: April 6th, 2025 appeared first on 9to5Linux - do not reproduce this article without permission. This RSS feed is intended for readers, not scrapers.

Try Firefox’s Experimental Link Previews with AI Summary

Hate having to read an article to understand what it’s saying and would rather read what an AI says it (potentially) says instead? Mozilla Firefox has your back. Saltiness aside, the latest nightly builds of Firefox 139 include an experimental web link preview feature which shows (among other things) an AI-generated summary of what that page is purportedly about before you visit it, saving you time, a click, or the need to ‘hear’ a real human voice. Firefox generates its AI summaries locally, on device – great for privacy but not for speed No data about you or the link […]

Hate having to read an article to understand what it’s saying and would rather read what an AI says it (potentially) says instead? Mozilla Firefox has your back. Saltiness aside, the latest nightly builds of Firefox 139 include an experimental web link preview feature which shows (among other things) an AI-generated summary of what that page is purportedly about before you visit it, saving you time, a click, or the need to ‘hear’ a real human voice. Firefox generates its AI summaries locally, on device – great for privacy but not for speed No data about you or the link […]

You're reading Try Firefox’s Experimental Link Previews with AI Summary, a blog post from OMG! Ubuntu. Do not reproduce elsewhere without permission.

Rust-Written Redox OS Makes USB 3.x Improvements, Async NVMe Driver Support

Mozilla Builders' LocalScore: An Interesting Local AI LLM Benchmark

Ubuntu 25.04 Boosting AMD EPYC 9005 Performance Even Higher: ~14% Faster Than Ubuntu 24.04 LTS

DXVK 2.6.1 Released With More Bug Fixes & Performance Optimizations

DXVK 2.6.1 brings numerous needed fixes for playing Windows games on Linux and Steam Deck

.

.

Read the full article on GamingOnLinux.

Palworld publisher teams up with MythicOwl for car delivery adventure Truckful

.

.

Read the full article on GamingOnLinux.

Twin Sails Interactive break off from Asmodee and Embracer to go independent

.

.

Read the full article on GamingOnLinux.

Five Year Old Ubuntu Bug For NVIDIA Suspend/Resume Experience: Now Working On X11, Wayland Not Yet

Build a train to expand your deck and fight off bandits in the demo for Fogpiercer

.

.

Read the full article on GamingOnLinux.

Master platforming with two characters at the same time in Ambidextro - from the dev of Pineapple on pizza

.

.

Read the full article on GamingOnLinux.

Nexus Mods improve the new open source app with UI upgrades, Cyberpunk 2077 fixes and more

.

.

Read the full article on GamingOnLinux.

Iron Village is a sweet super-casual city-builder and railway manager out now

.

.

Read the full article on GamingOnLinux.

Linux GPU Control Application (LACT) v0.7.3 brings configurable charts, improvements for AMD RDNA3

.

.

Read the full article on GamingOnLinux.