Appels illimités et 1 Go chez Free : le forfait 2 € sort de la préhistoire

Retrouvez un résumé du meilleur de l’actu tech tous les matins sur WhatsApp, c’est notre nouveau canal de discussion Frandroid que vous pouvez rejoindre dès maintenant !

Retrouvez un résumé du meilleur de l’actu tech tous les matins sur WhatsApp, c’est notre nouveau canal de discussion Frandroid que vous pouvez rejoindre dès maintenant !

Les temps sont durs pour la RAM, on ne le sait que trop bien, mais ils sont maintenant en train de le devenir pour le stockage. On savait que cela allait arriver, mais cela fait tout de même mal. Voici l'occasion d'avoir tout de même une belle quantité de stockage externe, si vous en avez besoin, po...

Les temps sont durs pour la RAM, on ne le sait que trop bien, mais ils sont maintenant en train de le devenir pour le stockage. On savait que cela allait arriver, mais cela fait tout de même mal. Voici l'occasion d'avoir tout de même une belle quantité de stockage externe, si vous en avez besoin, po...

Abonnez-vous à Frandroid sur Google pour ne manquer aucun article !

Abonnez-vous à Frandroid sur Google pour ne manquer aucun article !

Grâce à un fichier de configuration YAML, WinGet DSC peut effectuer la configuration d'une machine Windows et même procéder à l'installation de logiciels.

Le post WinGet DSC : une approche moderne pour préparer une machine Windows 11 a été publié sur IT-Connect.

Des mises à jour qui cassent, des BSOD à répétition, et une base d’utilisateurs qui grince des dents. Microsoft remet Windows 11 au centre de la table avec un plan de stabilisation prioritaire.

Microsoft concentre ses ressources d’ingénierie pour corriger les dérives fonctionnelles de Windows 11 et de ses services. L’entreprise applique un modèle de « swarming » afin d’accélérer la résolution des problèmes critiques qui accompagnent trop souvent les mises à jour.

Pavan Davuluri, président de Windows and devices, indique que les retours des Insiders et des clients imposent un recentrage net : performance système, fiabilité et expérience globale. Les priorités portent sur les BSOD récurrents, les bugs atypiques et les dysfonctionnements d’applications cœur.

Windows 11 revendique désormais 1 milliard d’utilisateurs, atteint en 1 576 jours, contre 1 706 jours pour Windows 10. Satya Nadella souligne une dynamique plus rapide qu’à l’ère Windows 10, portée par la fin de vie de Windows 10 et les mises à niveau en entreprise.

La division Windows affiche une croissance annuelle de 5 %, ce qui renforce l’enjeu de stabiliser la base installée. Pour les intégrateurs et les power users, la réduction des régressions post-update devient le critère numéro un avant déploiement.

Si l’approche « swarming » est correctement exécutée, on peut s’attendre à une baisse mesurable des incidents critiques sur les rings de diffusion et à une latence de correctifs plus courte. C’est ce qui conditionnera le retour de Windows 11 comme plateforme de référence pour les configurations haut de gamme et les environnements de production sensibles.

Source : TechPowerUp, The Verge

Lors de la conférence investisseurs consacrée aux résultats du quatrième trimestre 2025, Elon Musk a reconnu que « Optimus est encore à un stade très précoce » et qu’aucun robot humanoïde Tesla n’assume aujourd’hui de tâches utiles en usine. Un net contre-pied avec ses déclarations publiques des deux dernières années, où il évoquait déjà des déploiements opérationnels et des volumes ambitieux.

Rappel chronologique sec. En juin 2024, le compte officiel de Tesla affirmait que deux robots Optimus exécutaient de façon autonome des missions en usine. Au même moment, Musk promettait entre 1 000 et 2 000 unités au travail d’ici 2025. En janvier 2025, il relevait encore la barre: environ 10 000 Optimus prévus en interne pour l’année, avec la confiance de les voir « faire des choses utiles » en fin d’exercice.

Un an plus tard, virage. Musk parle désormais d’un programme en R&D, avec des itérations qui rendent rapidement obsolètes les versions précédentes. Les robots ont réalisé « des tâches basiques », mais pas d’utilisation « substantielle » en production. Interrogé sur le nombre d’exemplaires réellement disponibles, le dirigeant n’a pas donné de chiffre.

Les démonstrations publiques de Tesla restent cantonnées à des gestes simples comme la remise d’une bouteille d’eau, souvent en téléopération, loin d’une autonomie robuste en environnement industriel. Dans sa dernière lettre aux actionnaires, la société annonce néanmoins un cap produit: Gen 3 attendu au premier trimestre, avec une refonte majeure par rapport à la version 2.5, notamment au niveau des mains, et présenté comme le premier design orienté production.

Tesla dit par ailleurs installer une ligne dédiée, avec un démarrage industriel visé d’ici fin 2026 et un objectif de capacité annuelle d’un million d’unités. À court terme, Musk évoque seulement la « possibilité » de volumes significatifs en fin d’année, sans engagement ferme.

La dissonance entre les promesses initiales et l’état réel du déploiement rappelle la difficulté de sortir un humanoïde de laboratoire pour l’exposer aux cadences, à la variabilité et aux exigences de sécurité d’une usine automobile. Le passage à Gen 3, centré sur la pré-industrialisation et la préhension, sera l’indicateur clé: s’il se concrétise avec des cycles d’itération plus lents mais stables, Tesla pourra aligner la narration produit avec des jalons vérifiables. À défaut, la fenêtre d’opportunité se refermera face aux approches plus spécialisées, moins spectaculaires, mais déjà monétisées sur des tâches ciblées.

Source : ITHome

DeepSeek muscle ses équipes sur deux fronts clés : un moteur de recherche IA multilingue et un socle d’agents autonomes à grande échelle. D’après plusieurs offres publiées en janvier, la société recrute des profils capables de concevoir une recherche multimodale acceptant texte, image et audio, et d’industrialiser l’entraînement, l’évaluation et le déploiement d’agents fonctionnant avec un minimum d’intervention humaine.

Les fiches de poste détaillent la mise en place de pipelines de données, de frameworks d’évaluation et de plateformes dédiées aux agents, avec la perspective de faire tourner un volume important de systèmes persistants sur le long terme. La dimension multilingue est explicitement prioritaire, signe d’une volonté d’adresser d’emblée des marchés hors du chinois et de l’anglais.

Cette accélération intervient un an après le choc provoqué par le modèle R1, présenté en janvier dernier, dont le rapport performance/coût a bousculé les références du secteur. Fin décembre, DeepSeek a publié un papier centré sur l’optimisation de l’efficacité du développement IA, un type de publication qui, chez l’entreprise, a déjà précédé des annonces de modèle. Officiellement, la feuille de route reste opaque, même si la mention « model1 » est apparue de façon discrète sur le GitHub de la société.

Plus d’une douzaine de postes illustrent la trajectoire stratégique: un moteur de recherche piloté par IA pour dépasser le paradigme du chatbot, et des agents outillés pour exécuter des tâches du quotidien de bout en bout. Le cadrage fait écho aux investissements d’OpenAI et d’Alphabet, tous deux engagés sur la recherche augmentée et les agents opérationnels.

DeepSeek revendique ouvertement l’ambition AGI et attend des profils capables de réfléchir au « chemin technique vers l’intelligence artificielle générale ». L’accent mis sur l’évaluation et l’infrastructure suggère une approche orientée production, avec des boucles de feedback mesurables et des services durables plutôt qu’une simple démonstration de labo.

Si aucun détail matériel n’est communiqué, la priorité donnée au multilingue et au multimodal cadre avec une montée en complexité des jeux de données et des outils d’orchestration. La combinaison recherche+agents implique des capacités robustes en retrieval, en planification et en exécution long contexte, où la concurrence pousse déjà vers des architectures plus efficaces en coût d’inférence.

Pour le marché, l’enjeu est clair: transformer des modèles performants en services utiles, continus et mesurables. Si DeepSeek parvient à reproduire le différentiel coût/perf de R1 sur la recherche et les agents, la pression sur les marges d’inférence et les tickets d’abonnement s’intensifiera, forçant les acteurs établis à accélérer sur l’optimisation et l’automatisation des workflows plutôt que sur la seule augmentation de la taille des modèles.

Source : ITHome

Un ARPG promet d’exploiter la déformation totale du terrain pour servir le gameplay, avec une exploration vraiment ouverte. Résultat attendu : des parties qui marquent durablement la carte et les choix de build.

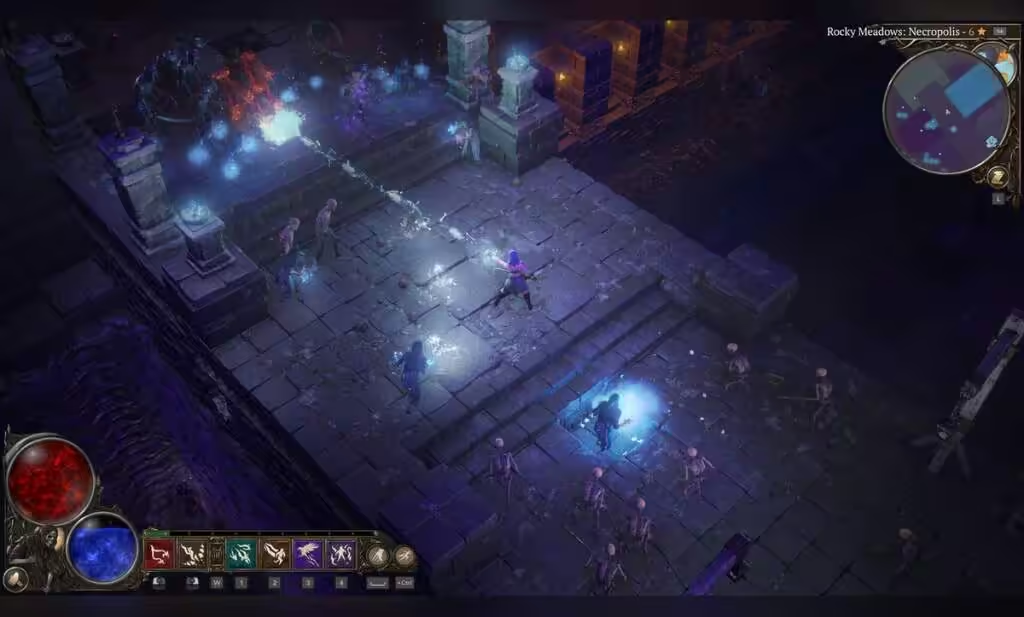

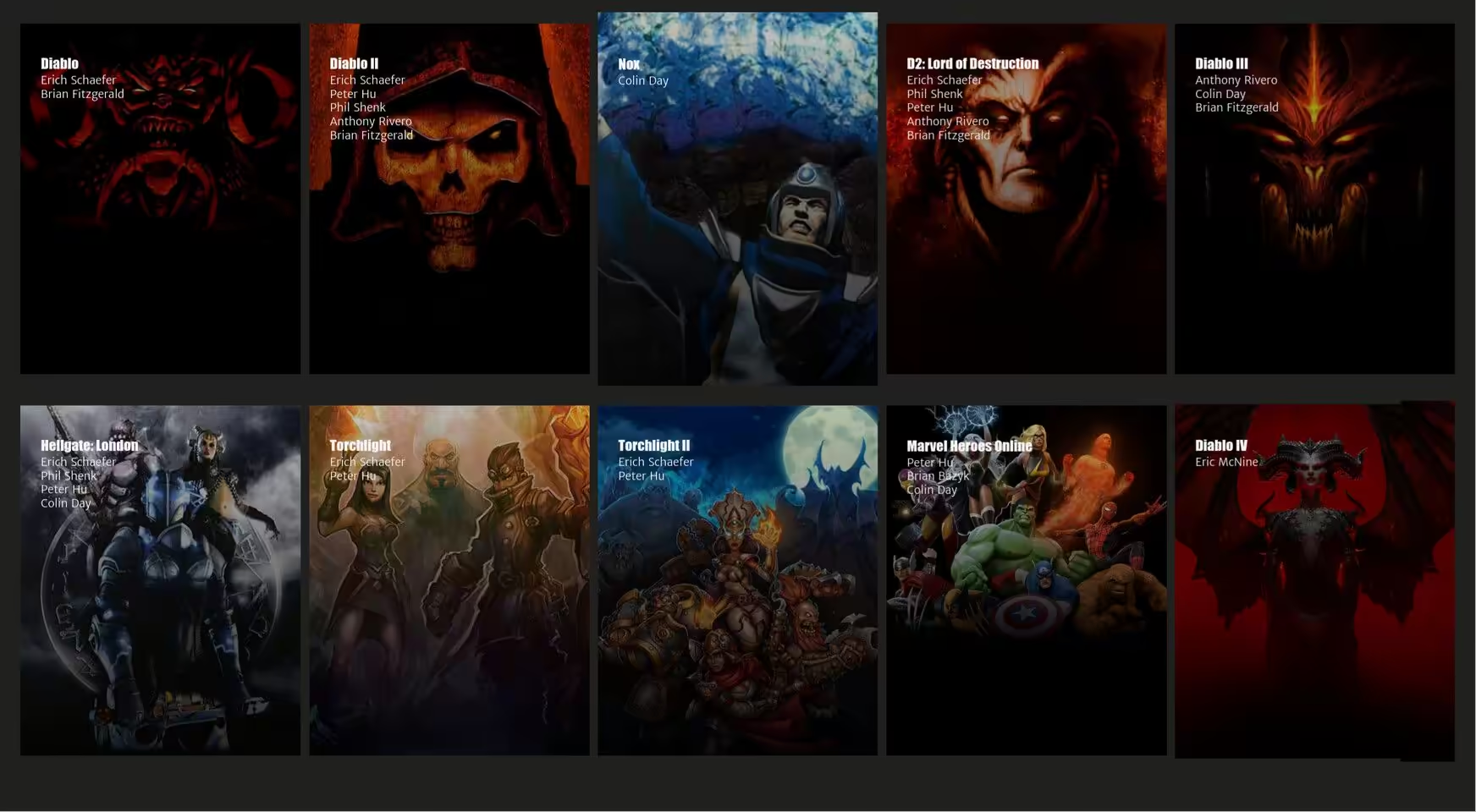

Officialisé le 29 janvier 2026, Darkhaven est un ARPG dark fantasy en vue isométrique signé Moon Beast Productions, studio fondé par Erich Schaefer, Philip Shenk et Peter Hu (ex-Blizzard, Diablo 1/2). L’équipe rassemble aussi des profils passés par Diablo 4, Marvel Heroes Online, Torchlight 1 et 3, et Nox.

Le cœur du projet repose sur des environnements procéduraux, entièrement déformables et persistants. Le terrain se creuse, se draine, se relève et se reconstruit : extraction de ressources, percement de murs, détournement de lave, remontée d’îlots, fortifications, ponts ou même établissements entiers.

La génération s’écarte des « couloirs et salles » classiques au profit d’assemblages de biomes via des règles écologiques et de points d’intérêt artisanaux. Objectif annoncé : des cartes uniques mais cohérentes, avec une histoire implicite lisible à l’écran.

Le studio évoque des événements massifs qui menacent le monde, avec brèches, corruptions et altérations de terrain permanentes. Chaque invasion laisse des cicatrices durables : cratères, ruines, structures modifiées, que les joueurs peuvent repousser puis rebâtir.

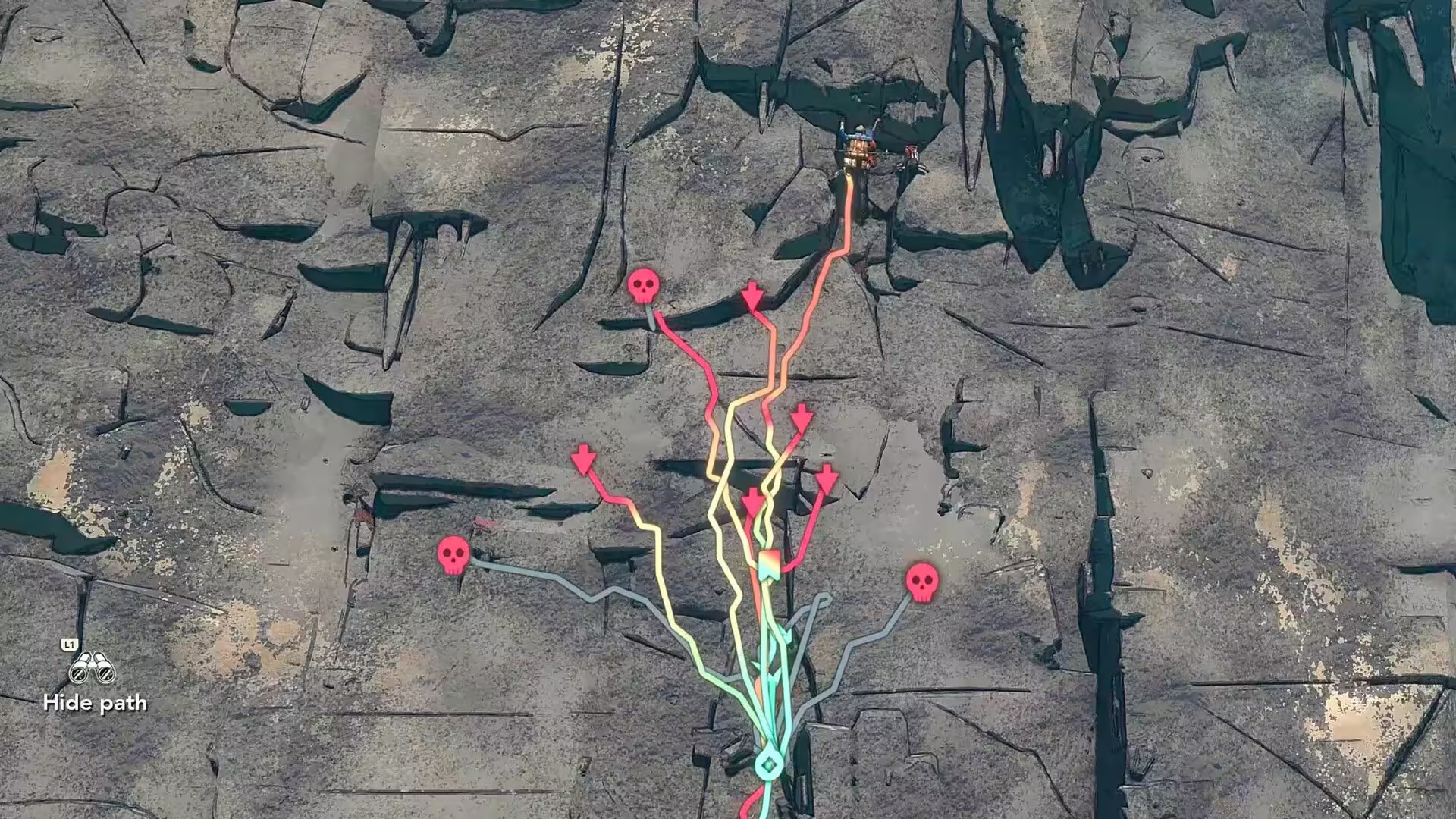

L’exploration est annoncée comme « réellement ouverte » avec déplacements libres : voler, nager, grimper, sauter pour contourner ou exploiter les reliefs en combat. Les interactions restent pilotées à la souris, dans la veine ARPG, avec un accent sur la tactique.

Au menu : coop en ligne et PvP, et des emprunts assumés au MORPG pour la gestion d’événements à grande échelle affectant l’instance du monde. La promesse centrale est la liberté d’approche, autant en navigation qu’en affrontement.

Côté loot, l’équipe rejette les micro-incréments « équilibrés mais fades ». Les objets rares doivent rester viables bien au-delà de leur plage de puissance attendue pour influencer les choix de build, sans « flèches vertes » ni nerfs systématiques d’items « trop bons ».

Darkhaven arrive « bientôt » en Early Access sur Steam, sans date précise, avec un financement au moins partiel via Kickstarter. Moon Beast Productions se présente clairement comme un développeur ARPG, laissant entendre un focus total sur ce titre pour le moment.

Si la déformation permanente du monde tient ses promesses côté netcode et persistance, le jeu peut s’installer sur une niche exigeante entre ARPG traditionnel et bac à sable systémique. Le vrai test portera sur la lisibilité des combats dans des terrains remodelés et sur l’équilibrage d’items volontairement « puissants » à long terme.

Source : TechPowerUp

La course à la mémoire AI s’intensifie, avec une cible claire : rapprocher capacité et bande passante du calcul. Les premiers à réussir imposeront le format.

Qualcomm et AMD évaluent l’intégration de mémoire SOCAMM2 dans leurs gammes dédiées à l’IA, avec l’objectif d’augmenter à la fois la capacité et la vitesse. Le mouvement intervient dans le sillage du CPU “Vera” de NVIDIA, qui adopte de la LPDDR5X sur un facteur SOCAMM et revendique 1,2 TB/s de bande passante mémoire, jusqu’à 1,5 TB de LPDDR5X.

Le principe : constituer un pool mémoire rapide au plus près des accélérateurs, en complément des piles HBM, afin de conserver des modèles entiers en RAM et limiter les allers-retours vers le stockage flash. NVIDIA entoure son CPU de plusieurs modules SOCAMM ; Qualcomm et AMD devraient adopter un schéma similaire.

Chez AMD, l’association Instinct MI et EPYC apparaît comme première candidate, même si un nouveau design n’est pas exclu. Côté Qualcomm, les cartes d’inférence AI200 et AI250 intègrent déjà jusqu’à 768 GB de LPDDR5 par carte : l’arrivée de SOCAMM permettrait d’industrialiser l’extension via des modules standardisés plutôt qu’un soudage à la carte.

Au-delà du gain de bande passante, SOCAMM2 offrirait une granularité produit : décliner des configurations en ajoutant ou retirant des modules, sans lourds reworks PCB. Objectif : des systèmes IA haute capacité et haute vitesse, avec une mémoire proche du calcul et des coûts d’intégration maîtrisés.

Si l’écosystème suit, SOCAMM2 pourrait devenir le pivot entre HBM et le stockage, imposant un standard modulaire côté CPU/accelerator et redéfinissant l’équilibre capacité/latence pour l’inférence et l’entraînement à grande échelle.

Source : TechPowerUp

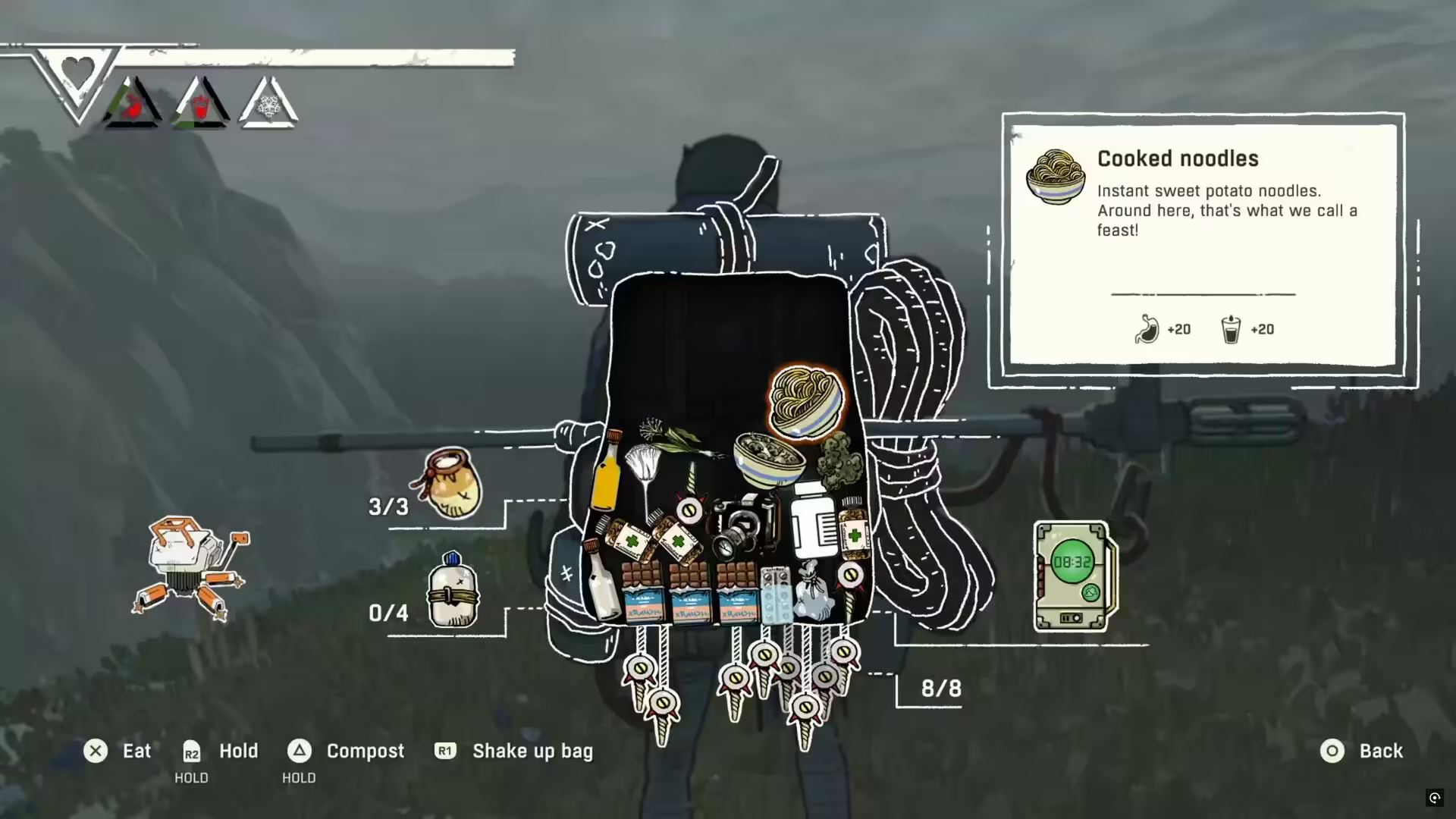

The Game Bakers lance aujourd’hui le jeu Cairn sur PlayStation 5, Steam, GOG et Epic Games Store. Le trailer de lancement dévoile davantage l’ascension d’Aava vers le Mont Kami et confirme un jeu d’escalade orienté survie, exploration et tension narrative.

Le titre sort avec une édition standard à 29,99 $ (env. 27,5 € TTC à titre indicatif) assortie d’une remise de 10 % au lancement. Une Edition Deluxe est proposée à 36,99 $ (env. 34 € TTC), incluant un guide de voyage du Kami par Mathieu Bablet et des souvenirs exclusifs liés au périple d’Aava.

L’OST originale, signée Martin Stig Andersen (Limbo, Inside, Control), The Toxic Avenger et Gildaa, est disponible séparément à 9,99 $ (env. 9,2 €). Le studio revendique plus de 600 000 téléchargements de la démo, évaluée à 99 % sur Steam.

Cairn met l’accent sur la planification d’itinéraire et la gestion des ressources, dont les pitons, pour affronter le Mont Kami. La progression s’appuie sur une liberté d’escalade « partout », avec des choix à risque et une pression permanente sur l’endurance et le matériel.

Au-delà du système d’ascension, le récit suit ce qu’Aava est prête à sacrifier pour une première mondiale. The Game Bakers, déjà auteurs de Furi et Haven, cherchent clairement à combiner mécaniques exigeantes et narration resserrée.

Pour un studio indépendant, l’élan initial (700 000 wishlists, démo plébiscitée) constitue un signal commercial fort. Le positionnement premium contenu, renforcé par une Edition Deluxe valorisant l’édition artistique, vise le public PC/PS5 en quête d’un gameplay systémique avec une identité audiovisuelle marquée.

Source : TechPowerUp

Le boîtier beige refait surface, mais avec du silicium de 2026 à l’intérieur. MAINGEAR lance une série limitée qui mêle look fin 90s et composants très haut de gamme.

Le MAINGEAR Retro98 reprend le SilverStone FLP02, un châssis « beige box » avec bouton « Turbo », serrure de façade et afficheur en façade (température), plus un I/O avant dissimulé et un câblage volontairement visible. Le Turbo, d’après SilverStone, force les ventilateurs à pleine vitesse. MAINGEAR conserve un support de refroidissement moderne sous le capot.

Les machines sont assemblées et testées dans l’atelier du constructeur dans le New Jersey. La variante MAINGEAR Retro98α se distingue par une boucle de watercooling sur mesure et une plateforme plus ambitieuse.

Au sommet, MAINGEAR associe un Ryzen 9 9950X3D à une GeForce RTX 5090. La gamme propose aussi une option avec le récent Ryzen 7 9850X3D. Les composants sont actuels malgré l’esthétique fin des années 1990.

La vente se fait en drop limité : 32 unités « standard » et 6 unités Retro98α, exclusivement sur la boutique MAINGEAR à partir du 29 janvier 2026. Quatre paliers tarifaires sont annoncés : 2 499 $ (Retro98 | 5070), 3 499 $ (Retro98 | 5080), 4 999 $ (Retro98 | 5090) et 9 799 $ (Retro98α). À titre indicatif, cela représente environ 2 300 €, 3 200 €, 4 600 € et 9 000 € selon le taux de change et hors taxes/import.

Cette série limitée vise clairement les collectionneurs et moddeurs qui veulent un look rétro sans compromis sur les perfs, tout en capitalisant sur une rareté organisée. Le positionnement tarifaire et le format drop devraient garantir une rotation rapide des stocks, avec une valeur de revente potentiellement soutenue sur la variante α.

Source : VideoCardz

Selon le Financial Times, Hugging Face a décliné fin 2024 une proposition d’investissement de 500 millions de dollars de Nvidia, qui aurait propulsé sa valorisation à 7 milliards. Le motif avancé par la start-up: éviter un investisseur dominant susceptible d’infléchir sa gouvernance.

La plateforme revendique 13 millions d’utilisateurs et l’hébergement de 2,5 millions de modèles publics et plus de 700 000 jeux de données. La popularité d’un modèle sur Hugging Face est devenue un indicateur rapide d’adoption par les développeurs, y compris pour des acteurs chinois comme DeepSeek ou Alibaba, qui y trouvent un vecteur de diffusion globale.

À rebours d’OpenAI, Google ou Anthropic qui monétisent l’accès à des modèles propriétaires, Hugging Face pousse les alternatives ouvertes et gratuites pour les développeurs. « Les modèles open source démocratisent l’IA et luttent contre la concentration du pouvoir », martèle Clément Delangue, cofondateur et CEO.

Le groupe a choisi un modèle freemium: environ 3 % des clients, principalement des grandes entreprises, paient pour des fonctions avancées comme davantage de stockage ou des dépôts privés. Delangue assure que la société a été rentable sur l’exercice 2025, avec une perte ponctuelle au premier trimestre liée à des investissements dans les datasets. Sur les 400 millions de dollars levés, environ la moitié resterait en trésorerie; la valorisation a atteint 4,5 milliards en 2023.

Hugging Face a cessé de financer des grands modèles maison après BLOOM en 2022, pour réduire les coûts et éviter de concurrencer les projets hébergés. L’entreprise réalloue ses moyens vers la robotique, les jeux de données et la recherche, avec le rachat discret de Pollen l’an dernier.

L’organisation reflète cette philosophie décentralisée: télétravail en priorité, bureaux aux États-Unis, au Royaume-Uni, en France et en Suisse, et une communication ouverte qui contraste avec les politiques de confidentialité strictes des grands groupes. Cette visibilité attire les offres de poaching et n’empêche pas des départs récents, certains ex-salariés pointant un décalage entre leurs missions et l’évolution rapide des priorités.

Les rémunérations des chercheurs s’échelonnent généralement entre 100 000 et 200 000 dollars annuels (environ 92 000 à 184 000 €), nettement inférieures aux packages millionnaires proposés par les GAFAM, mais conformes aux standards start-up. En contrepartie, la direction met en avant une mission explicite: contrer l’hégémonie des modèles fermés et laisser aux chercheurs la liberté de leurs sujets.

Pour Thomas Wolf, cofondateur et Chief Science Officer, la montée en puissance de DeepSeek valide l’approche: « L’open source n’est pas une voie de seconde classe; il peut être très impressionnant. » Cette traction renforce la position de Hugging Face comme place de marché de facto des briques IA ouvertes.

Le refus du ticket Nvidia s’inscrit dans une logique de neutralité d’infrastructure. En restant indépendant d’un fournisseur de GPU, Hugging Face préserve sa crédibilité auprès des communautés et des partenaires cloud concurrents de Nvidia. À moyen terme, ce positionnement peut peser sur la répartition des budgets IA: il consolide un canal de distribution des modèles ouverts, impose des métriques d’adoption publiques et maintient une pression concurrentielle sur les offres fermées, y compris sur les prix d’inférence et les stratégies d’optimisation matérielle.

Source : ITHome

Mark Zuckerberg amorce un recentrage. Lors de l’appel aux résultats du quatrième trimestre, le patron de Meta a indiqué que Reality Labs approche d’un « point d’inflexion » après des années de pertes massives, avec une trajectoire de dépenses qui bascule des casques VR vers des lunettes connectées et des wearables dopés à l’IA. Il anticipe une perte 2025 comparable à l’an dernier, avant une décrue progressive.

Meta a durci le ton en interne en janvier : plus de 1 000 postes supprimés chez Reality Labs, trois studios VR fermés, arrêt d’une application de réunions en réalité virtuelle, et gel des projets de casques tiers sous Horizon OS. En miroir, la priorité passe aux lunettes « intelligentes » et aux dispositifs portés au quotidien, piliers de la vision d’une IA « superintelligente » accessible en continu.

Zuckerberg affirme que les lunettes connectées de Meta ont « plus que triplé » leurs ventes en 2025 et que la feuille de route AR s’accélère. Il décrit des AI glasses capables de voir et d’entendre ce que voit et entend l’utilisateur, de dialoguer, d’afficher des informations dans le champ de vision ou de générer des interfaces contextuelles.

Horizon reste central comme couche de distribution et de création. Meta veut y marier l’héritage « metaverse » et les modèles d’IA générative : création de mondes et de mini-jeux via simples prompts, partage instantané, et accès depuis un flux classique avec bascule en 3D immersive ou en 2D. Objectif affiché : porter ces expériences sur mobile pour atteindre des centaines de millions d’utilisateurs, tout en rendant l’écosystème VR rentable sur un horizon de quelques années.

Un détail révélateur: Zuckerberg n’a pas prononcé le mot « métavers » tout au long de l’échange. Le message est clair côté capex produit et logiciel, la VR demeure mais perd son statut de pari principal au profit d’un continuum IA porté par des lunettes et wearables, potentiellement plus faciles à industrialiser et à monétiser.

Si la VR reste en arrière-plan, Meta verrouille un axe où l’intégration verticale compte: modèles d’IA maison, OS/service Horizon, et hardware léger à forte récurrence d’usage. Ce basculement pourrait rebattre les cartes face à Apple et ses Vision Pro encore premium, et contraindre les partenaires historiques de l’écosystème VR à revoir leurs plans alors que l’option « Horizon OS tiers » est mise en pause. La clé sera la valeur perçue des AI glasses au quotidien et la capacité à convertir l’explosion des usages IA en revenus récurrents sans refaire l’erreur d’un hardware coûteux à faible attach rate.

Source : ITHome

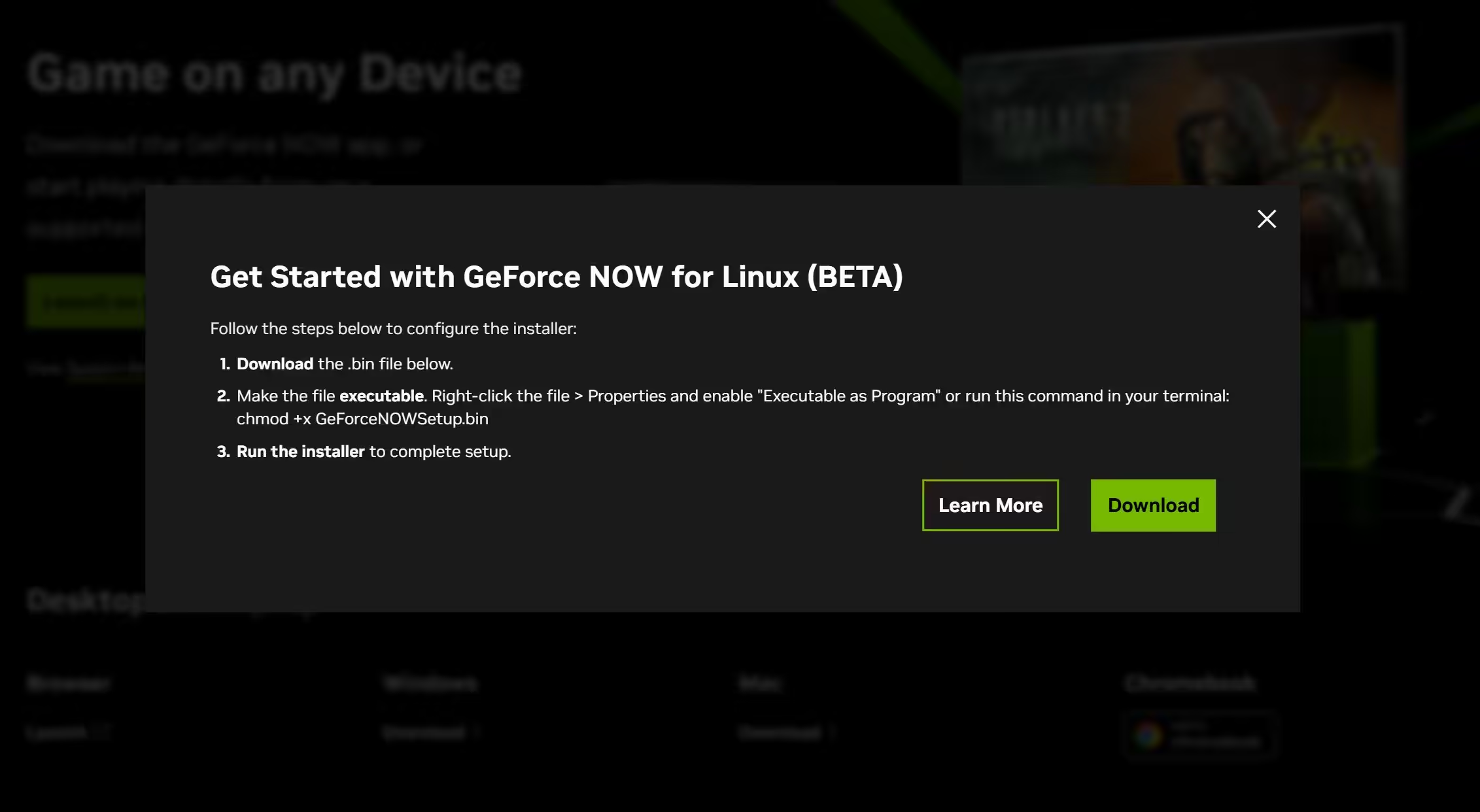

Linux gagne enfin un client natif GeForce NOW en bêta. Conséquence directe : le cloud gaming NVIDIA devient viable sans bricolage côté desktop.

NVIDIA publie une application desktop native GeForce NOW pour Linux en bêta, avec un support officiel initial d’Ubuntu 24.04 et de SteamOS. Le binaire est distribué en Flatpak, ce qui ouvre la porte à d’autres distributions si Flatpak est installé, sous réserve des versions recommandées de pilotes NVIDIA et de Mesa pointées par GamingOnLinux.

Sur Steam Deck, l’usage via le mode Bureau SteamOS était déjà possible : l’app native étend désormais l’expérience aux PC Linux standards. À l’inverse, Bazzite ne passe pas à ce stade : connexion OK mais erreurs de timeout et crash après le lancement selon les tests de Ben Wilson (Windows Central).

Sans client Xbox officiel sous Linux, GeForce NOW reste une voie d’accès indirecte à une partie des titres PC Game Pass. Après liaison du compte Microsoft, seuls les jeux pris en charge côté cloud NVIDIA sont streamés, puisque l’exécution se fait sur les machines distantes de l’opérateur.

NVIDIA rattache le déploiement Linux à l’upgrade Blackwell pour l’offre Ultimate : jusqu’à 5K à 120 FPS, ou 1080p à 360 FPS, avec du matériel de classe RTX 5080 sur les jeux compatibles. Le palier gratuit conserve des sessions d’1 heure. Le plafond mensuel de 100 heures pour la plupart des abonnés payants s’applique largement depuis le 1er janvier 2026.

L’annonce de la bêta Linux date du 29 janvier 2026. NVIDIA redirige vers la page de téléchargement GeForce NOW et les articles de support dédiés à Linux. Les tests à venir sur d’autres distributions permettront de préciser le périmètre réel du « known-good » au-delà d’Ubuntu 24.04.

Pour les joueurs Linux, l’arrivée d’un client natif crédibilise la plateforme pour le cloud gaming haut de gamme, mais la variabilité inter-distros et la politique de quotas d’heures incitent à valider l’usage sur son setup avant de s’engager.

Source : VideoCardz, NVIDIA, Linux Requirements, Windows Central, GamingOnLinux

Vous avez sûrement déjà eu ce moment de solitude où vous devez filer le mot de passe du WiFi, de Netflix ou d'un compte commun à un pote. Et là, comme un mec bourré qui recontacte son ex après une soirée déprimante, vous finissez par l'envoyer par SMS ou l'écrire sur un bout de papier qui finira à la poubelle.

C'est le genre de truc qui rend dingue niveau sécurité, mais bon, dans la vraie vie on le fait tous !

Au début, je cherchais donc juste un moyen simple de faire ça proprement, et je suis tombé sur ShareMyLogin. C'est un petit outil open source très bien pensé qui permet de partager des identifiants (ou n'importe quel secret) via un lien unique, en chiffrant tout directement dans votre navigateur (Chrome, Firefox, peu importe).

Le principe vous le connaissez, c'est du Zero Knowledge. Du coup, comme le chiffrement se fait localement avant l'envoi, le serveur ne reçoit techniquement que des données illisibles. C'est dans l'esprit de ce que proposent des services comme Bitwarden Send ou LockTransfer pour les pros , mais ici sous forme d'un petit outil dédié et gratuit.

Côté technique, on retrouve donc bien de l'AES-256-GCM pour le chiffrement et du PBKDF2 (avec 250 000 itérations) pour la dérivation de clé. Concrètement, vous tapez votre secret, l'outil génère un lien, et hop, vous filez ce lien à votre destinataire.

Ce qui est cool, c'est que le code est disponible sur

GitHub

. Je vous invite d'ailleurs à aller jeter un oeil à encrypt.ts et decrypt.ts qui montrent bien que la crypto est gérée côté client. Après, si vous utilisez la version hébergée, vous devrez faire confiance à l'administrateur pour qu'il ne modifie pas le code à la volée. Mais si vous hébergez votre propre instance, ce qui est franchement conseillé si vous êtes à cheval sur la sécu, c'est top !

Bien sûr pour le partage de mots de passe critiques au quotidien, je vous recommande d'utiliser les fonctions de partage de votre gestionnaire de mots de passe habituel. Mais pour un dépannage ponctuel, genre filer le code du digicode à un livreur ou un accès temporaire, ShareMyLogin fera très bien le job.

Le projet propose aussi une API si vous voulez intégrer ça dans vos propres moulinettes.

L'Europe spatiale consolide son autonomie. Un nouveau contrat vient sceller le destin d'Ariane 6 avec la constellation Galileo. Il assure le déploiement de la nouvelle génération de satellites.

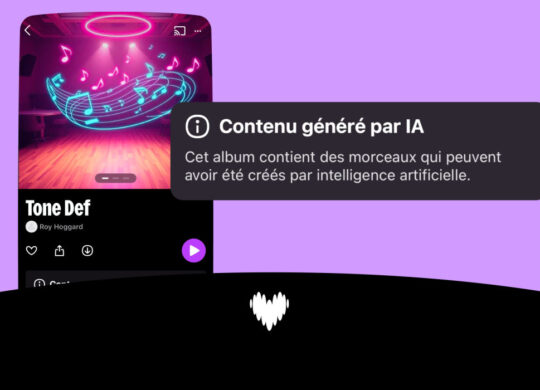

Un an après avoir lancé son propre outil de filtrage, Deezer franchit une nouvelle étape stratégique : la plateforme française met en vente sa technologie de détection de musique générée par intelligence artificielle. Cette ouverture au marché s’adresse directement aux autres acteurs de l’industrie musicale (labels, distributeurs et …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article Deezer propose son outil de détection de musiques IA aux concurrents est apparu en premier sur KultureGeek.

C’est une excellente nouvelle pour les amateurs de post-apocalyptique qui n’ont pas d’abonnement à Amazon Prime Video. Amazon a mis en ligne l’intégralité de la première saison de sa série à succès Fallout sur sa chaîne YouTube française. Les huit épisodes sont accessibles en cliquant ici, offrant une …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article La série Fallout est disponible en streaming gratuit sur YouTube est apparu en premier sur KultureGeek.

Azeroth est vaste, suffisamment pour accueillir des parties de cache-cache. Vous ne rêvez pas : c'est l'une des futures activités que Blizzard prévoit pour World of Warcraft. Et c'est sans doute une excellente idée pour maintenir l'intérêt des joueurs et des joueuses à l'égard du MMORPG.