Intel ne compte pas suivre AMD sur la voie des iGPU surdimensionnés. Face à Strix Halo, la réponse du fondeur est nette : ce n’est pas une direction qu’il juge pertinente.

Interrogé par Club386, Tom Petersen, fellow chez Intel et figure clé du pôle graphique, écarte explicitement l’idée d’un équivalent maison à Strix Halo. Selon lui, ce segment serait mieux servi par un GPU dédié compact que par un iGPU surdimensionné intégré au processeur.

Derrière cette déclaration se dessine une rupture stratégique assumée entre deux visions opposées du futur graphique en mobilité.

Pourquoi Intel refuse de suivre AMD

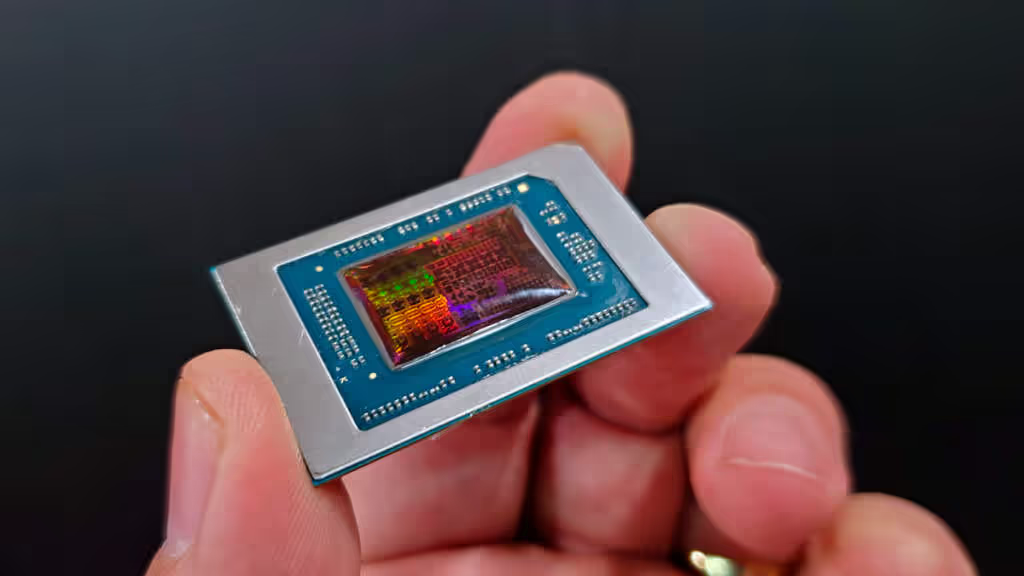

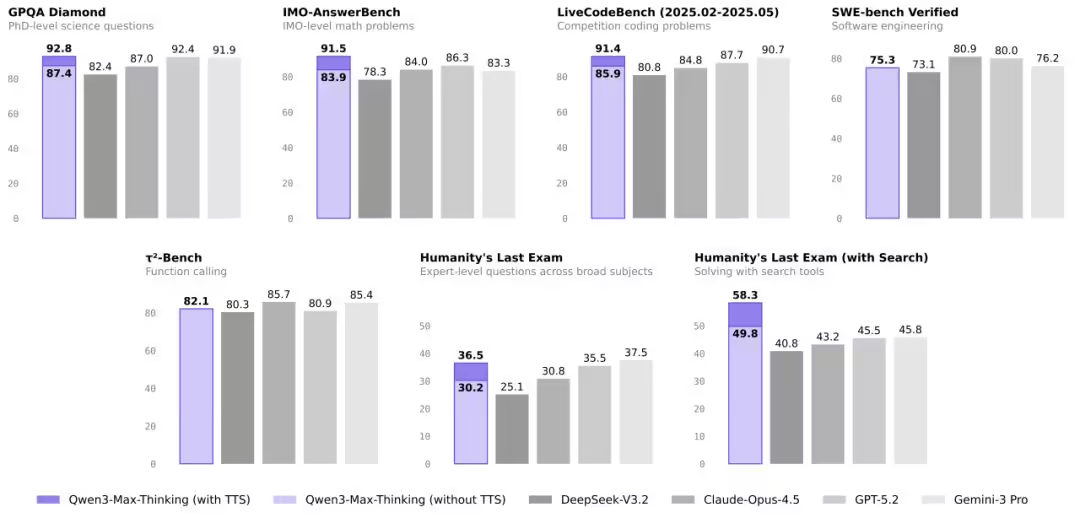

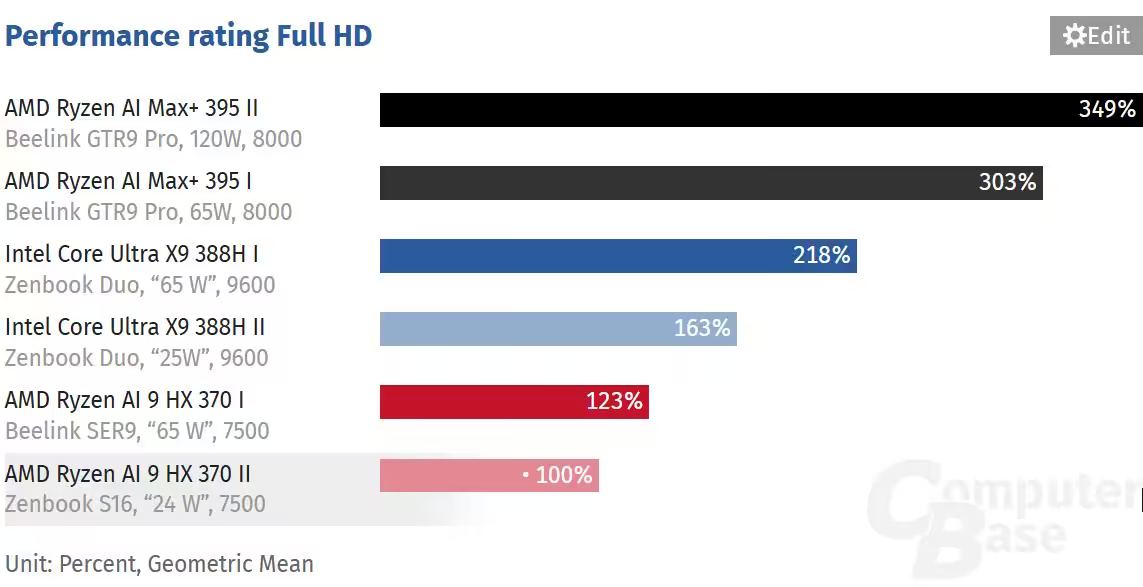

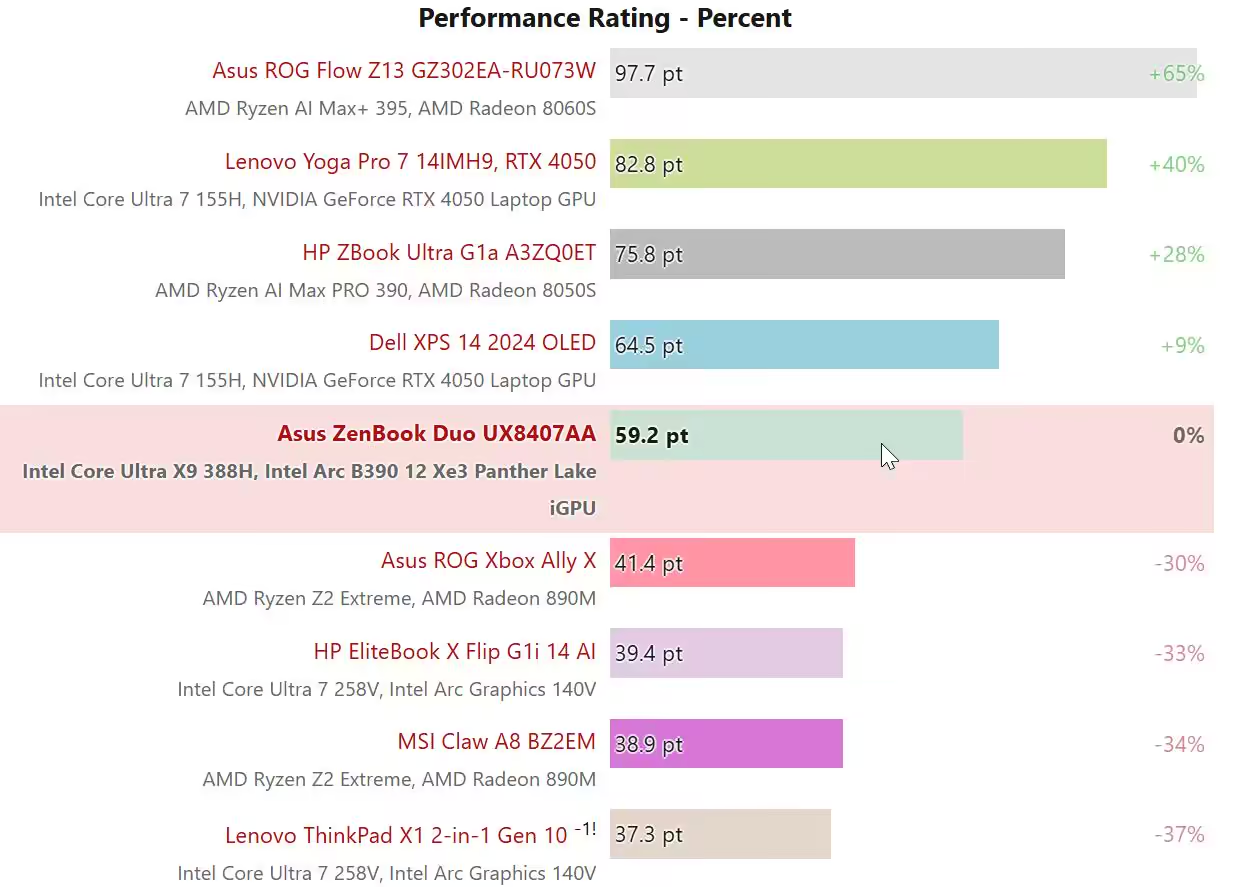

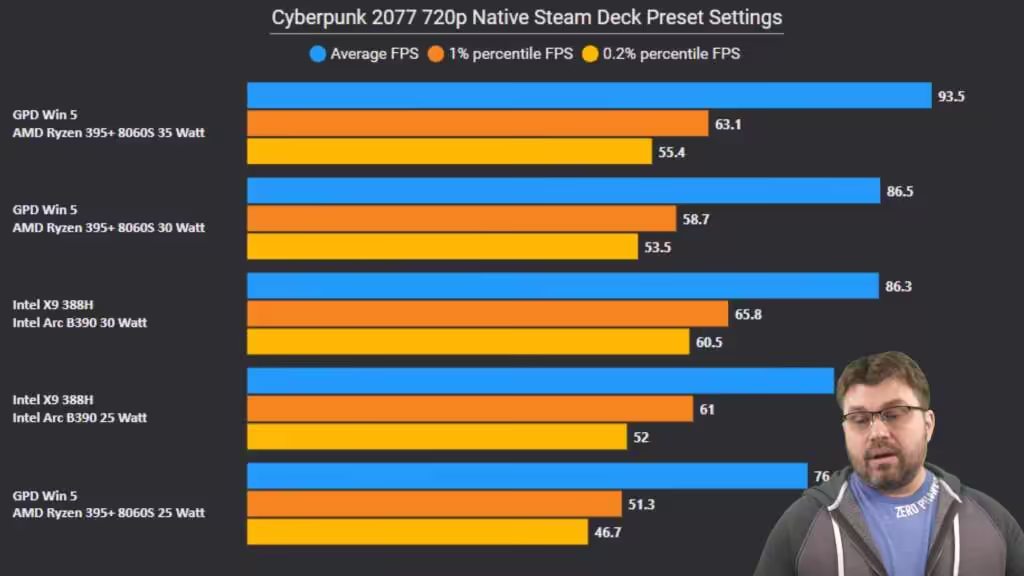

Intel ne remet pas en cause l’intérêt technique de Strix Halo. La plateforme Ryzen AI Max+ démontre qu’un iGPU peut atteindre des niveaux de performances jusque-là réservés à des GPU dédiés d’entrée de gamme. Mais pour Intel, le problème n’est pas technologique, il est structurel.

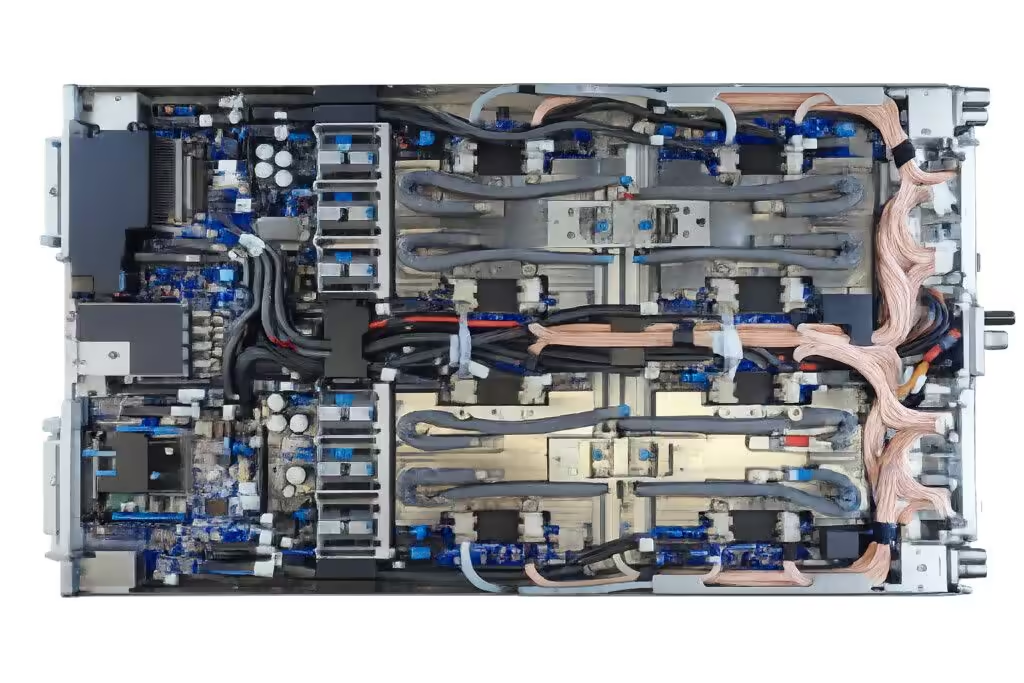

Un iGPU géant implique une surface de silicium importante, des coûts de production plus élevés et une pression thermique difficile à maîtriser dans des formats mobiles. À mesure que la taille du GPU intégré augmente, l’équilibre entre consommation, rendement et flexibilité se dégrade.

Tom Petersen l’exprime sans détour : dès lors que l’on sort du périmètre du graphique intégré classique, le GPU dédié redevient plus pertinent. Pour Intel, cette frontière ne doit pas être brouillée.

Les progrès récents des iGPU Intel changent la donne

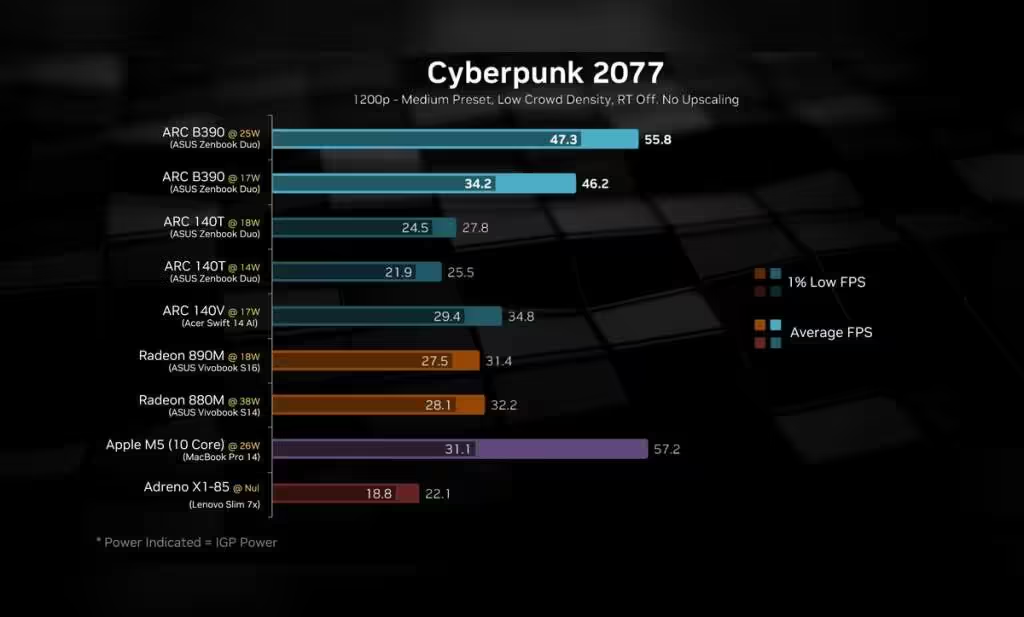

Cette position serait difficile à défendre si les iGPU Intel restaient en retrait. Or, la génération Core Ultra récente marque un vrai tournant. Les graphiques intégrés Arc ont progressé de manière visible, offrant désormais une expérience correcte en jeu occasionnel et des performances solides pour les usages quotidiens.

Intel estime avoir atteint son objectif : proposer un iGPU suffisamment performant pour couvrir la majorité des usages, sans exploser les budgets énergétiques. Aller au-delà ne relèverait plus de l’iGPU, mais d’un autre produit.

Dans cette logique, Strix Halo apparaît moins comme un modèle à suivre que comme une exception volontairement extrême.

Strix Halo, une approche radicalement différente

Du côté d’AMD, la démarche est inverse. Strix Halo assume une approche brute : multiplier les unités de calcul, augmenter la surface GPU et viser des performances maximales, quitte à s’éloigner des standards habituels du graphique intégré.

Ce positionnement n’est pas pensé avant tout pour le gaming classique. AMD vise surtout les stations de travail mobiles, la création de contenu et certaines charges de calcul GPU, dans des machines où l’ajout d’un GPU dédié n’est pas toujours souhaitable.

Dans ce contexte, l’iGPU géant devient un compromis assumé plutôt qu’un non-sens technique.

Performance par watt, l’argument central d’Intel

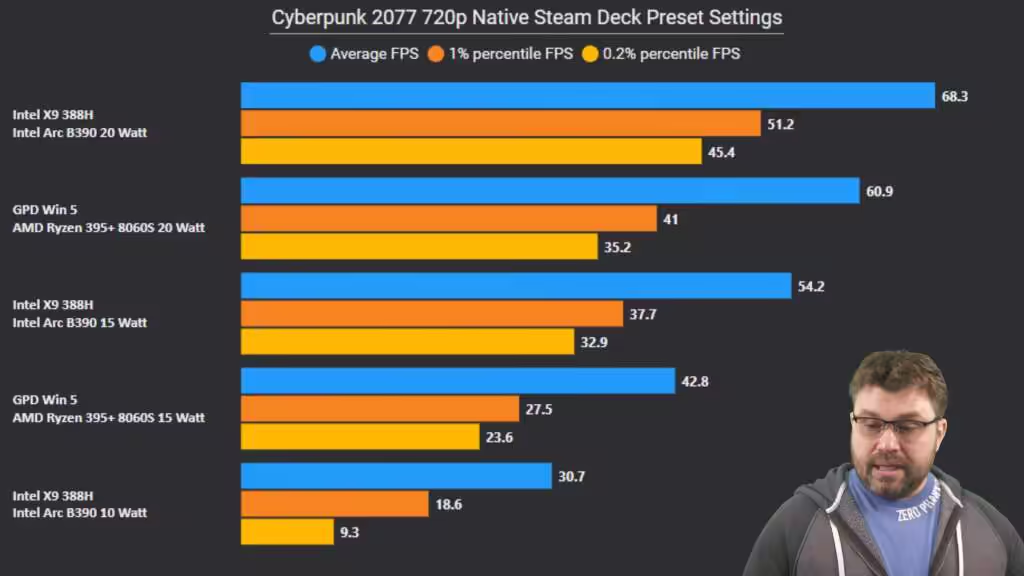

Intel insiste sur un point clé : la performance par watt. Selon Tom Petersen, les solutions de type Strix Halo ne seraient pas compétitives sur ce terrain, un critère pourtant décisif en mobilité et dans les ultraportables premium.

Un GPU intégré de grande taille consomme davantage, chauffe plus et limite les marges d’optimisation thermique. À l’inverse, un GPU dédié compact peut être activé uniquement lorsque nécessaire, tout en laissant l’iGPU gérer les tâches légères.

Cette approche modulaire correspond davantage à la vision d’Intel, qui préfère multiplier les options plutôt que de tout concentrer dans un seul bloc de silicium.

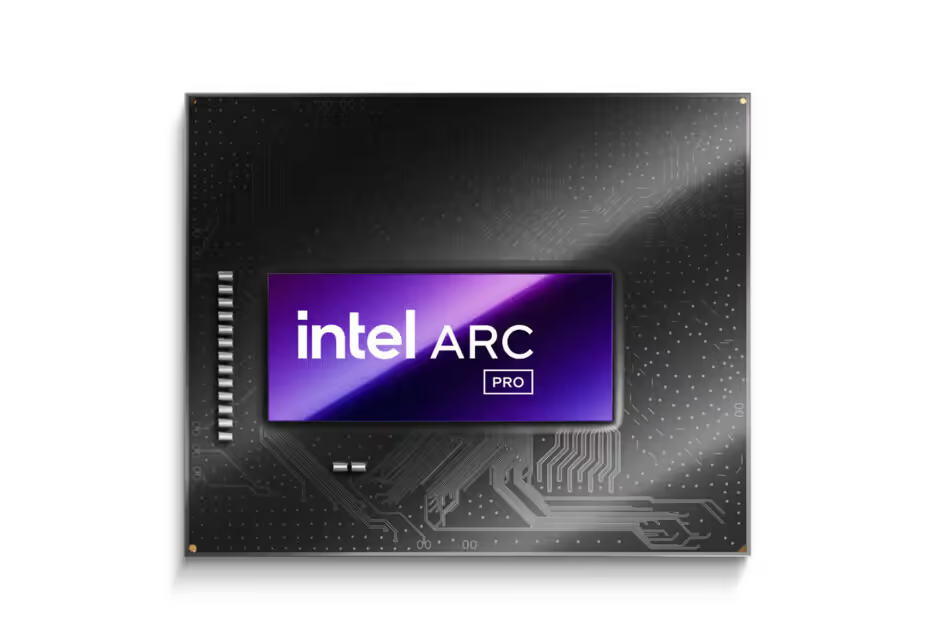

Intel prépare la suite côté GPU dédiés

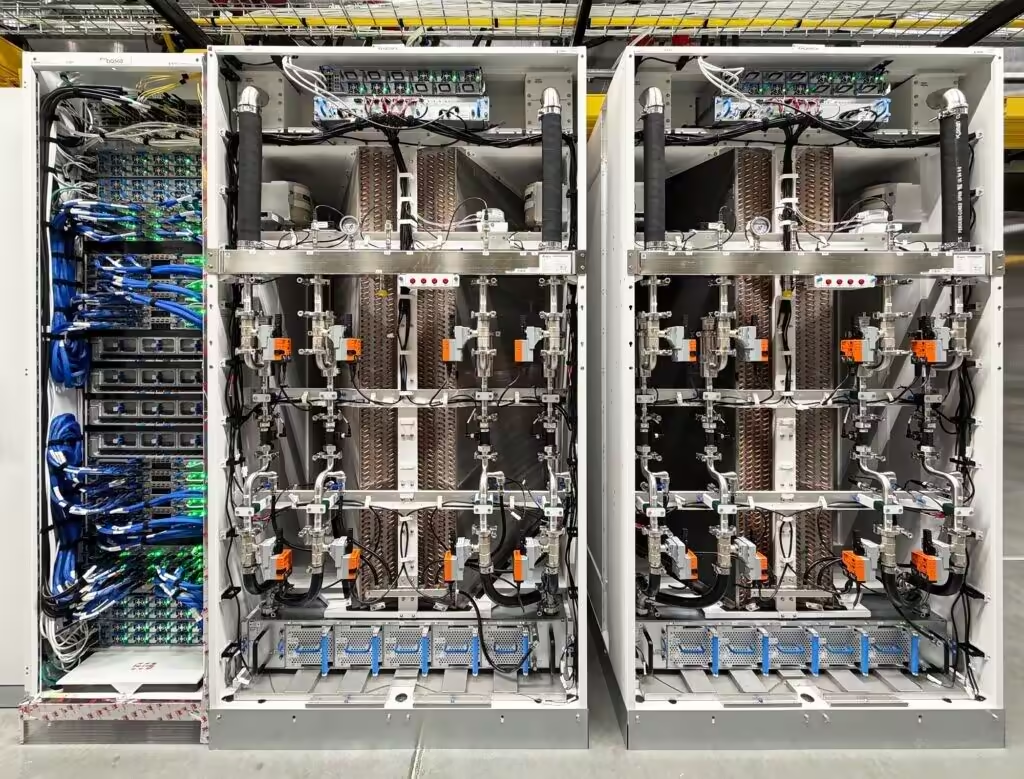

Refuser Strix Halo ne signifie pas abandonner le graphique. Intel continue d’investir lourdement dans ses GPU dédiés Arc, avec une attention particulière portée à l’efficacité énergétique et à l’intégration.

Les prochaines générations Battlemage doivent justement incarner cette stratégie : proposer des GPU dédiés plus compacts, capables de compléter efficacement un iGPU moderne, sans les compromis d’un iGPU géant intégré au CPU.

Pour Intel, l’avenir du graphique passe par une séparation claire des rôles, pas par leur fusion extrême.

Deux visions, un même objectif

AMD et Intel poursuivent finalement le même but : offrir plus de performances graphiques dans des machines toujours plus compactes. Mais leurs chemins divergent radicalement.

AMD pousse le concept d’iGPU jusqu’à ses limites. Intel préfère renforcer l’efficacité globale et s’appuyer sur des GPU dédiés lorsque la puissance devient critique.

Le marché décidera laquelle de ces visions s’imposera. Une chose est certaine : face à Strix Halo, Intel ne se justifie pas. Il tranche.

Si Intel refuse la surenchère « APU géant », le marché pourrait se scinder: d’un côté des laptops IA-first avec iGPU massifs à prix premium, de l’autre des plateformes plus équilibrées où un iGPU gaming « suffisant » s’adosse à des dGPU d’entrée de gamme. Le point dur restera l’efficacité: si AMD convertit les 2 560 SP du 8060S en gains réels par watt, l’équation tarif/performances pourrait rebattre les cartes en 2026.

Source : Club386 via VideoCardz