ASUS GPU Tweak III active Level Sense sur les ROG Astral et affine la stabilité

Une alerte anti-sag directement dans l’utilitaire d’overclocking, et plus seulement pour l’élite Matrix. ASUS étend sa détection d’inclinaison aux ROG Astral, avec à la clé des notifications si la carte penche au-delà d’un seuil réglable.

Level Sense arrive sur les ROG Astral

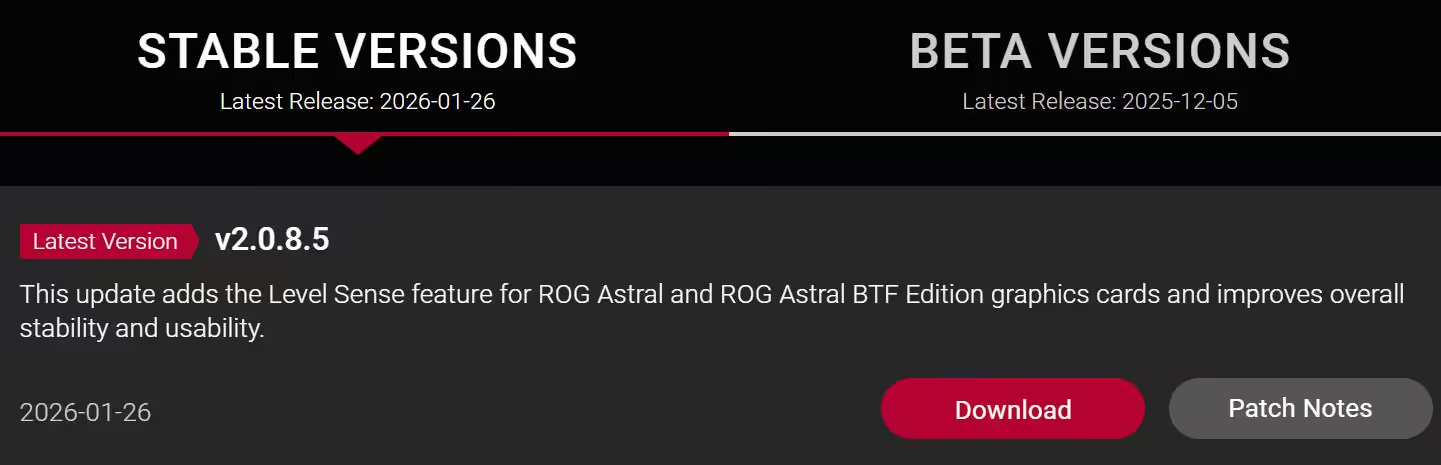

ASUS met à jour GPU Tweak III en version v2.0.8.5 pour activer Level Sense sur les ROG Astral et ROG Astral BTF Edition. Le constructeur annonce également des améliorations de stabilité et d’ergonomie.

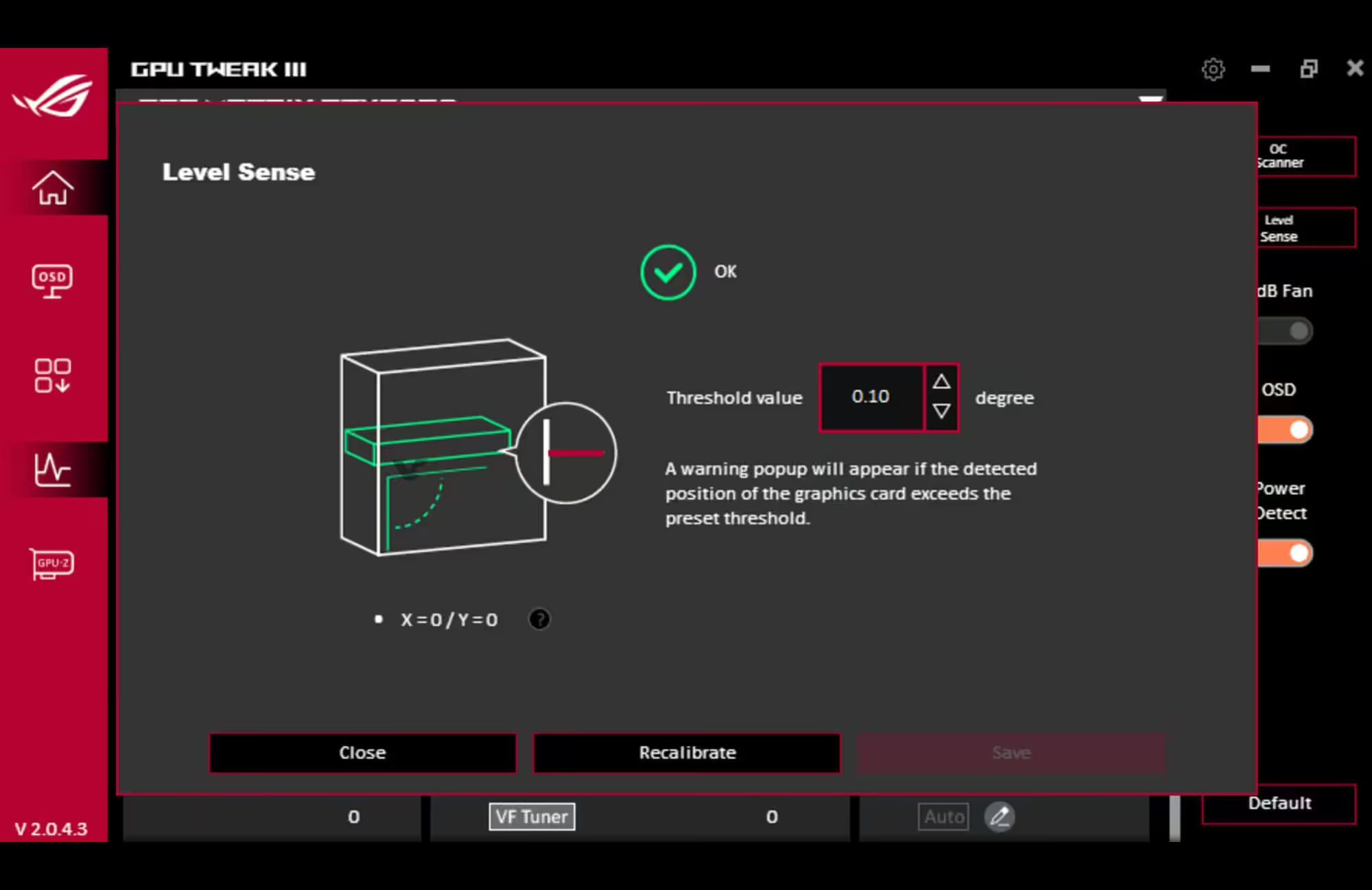

Level Sense est un contrôle anti-sag basé sur des capteurs embarqués qui détectent si la carte graphique n’est plus à niveau. Une alerte s’affiche dès que l’inclinaison mesurée dépasse un seuil défini par l’utilisateur.

Jusqu’ici réservé aux modèles ROG MATRIX, le dispositif s’ouvre désormais aux Astral. ASUS avait déjà documenté la prise en charge pour les ROG Matrix GeForce RTX 5090 30th Anniversary avant ce déploiement.

Seuil, calibration et notifications

Dans GPU Tweak III, l’onglet Level Sense permet de fixer immédiatement un seuil ou de lancer une calibration après l’installation. ASUS indique un seuil par défaut de 0,30 degré; le réduire augmente la sensibilité des alertes.

Si l’inclinaison dépasse la limite, l’application peut afficher un avertissement et pousser des notifications en arrière-plan. En cas d’angle d’installation inhabituel, ASUS recommande de réinstaller la carte.

Le déploiement sur Astral s’inscrit dans une logique de durabilité matérielle: un contrôle natif du sag limite les contraintes mécaniques sur le PCB et les connecteurs, ce qui évite d’imposer des supports tiers et sécurise l’usage dans des boîtiers vitrine.

Source : VideoCardz