Pour ChatGPT, donner l’heure reste plus compliqué que de disserter sur la physique quantique

ChatGPT et les autres LLM ont inclut récemment une fonction qui manquait étonnamment à ces chatbots : étrangement, ils étaient totalement incapables de donner correctement l’heure qu’il était avec précision. L’ajout de cette fonction temporelle, si elle paraît mineure, engage pourtant des changements et évolutions bien plus importants qu’on ne le pense à première vue.

À force d’en parler comme d’un « assistant intelligent », on finissait presque par oublier un détail embarrassant : jusqu’à récemment, ChatGPT ne savait pas quel jour on était. Il pouvait disserter sur la théorie de la relativité, mais était incapable de dire si votre rendez‑vous de demain avait déjà eu lieu. L’illusion tenait tant qu’on restait dans les généralités. Dès que la conversation se rapprochait un peu trop du réel, elle se fissurait : l’IA vivait dans un passé figé, et vous dans le présent.

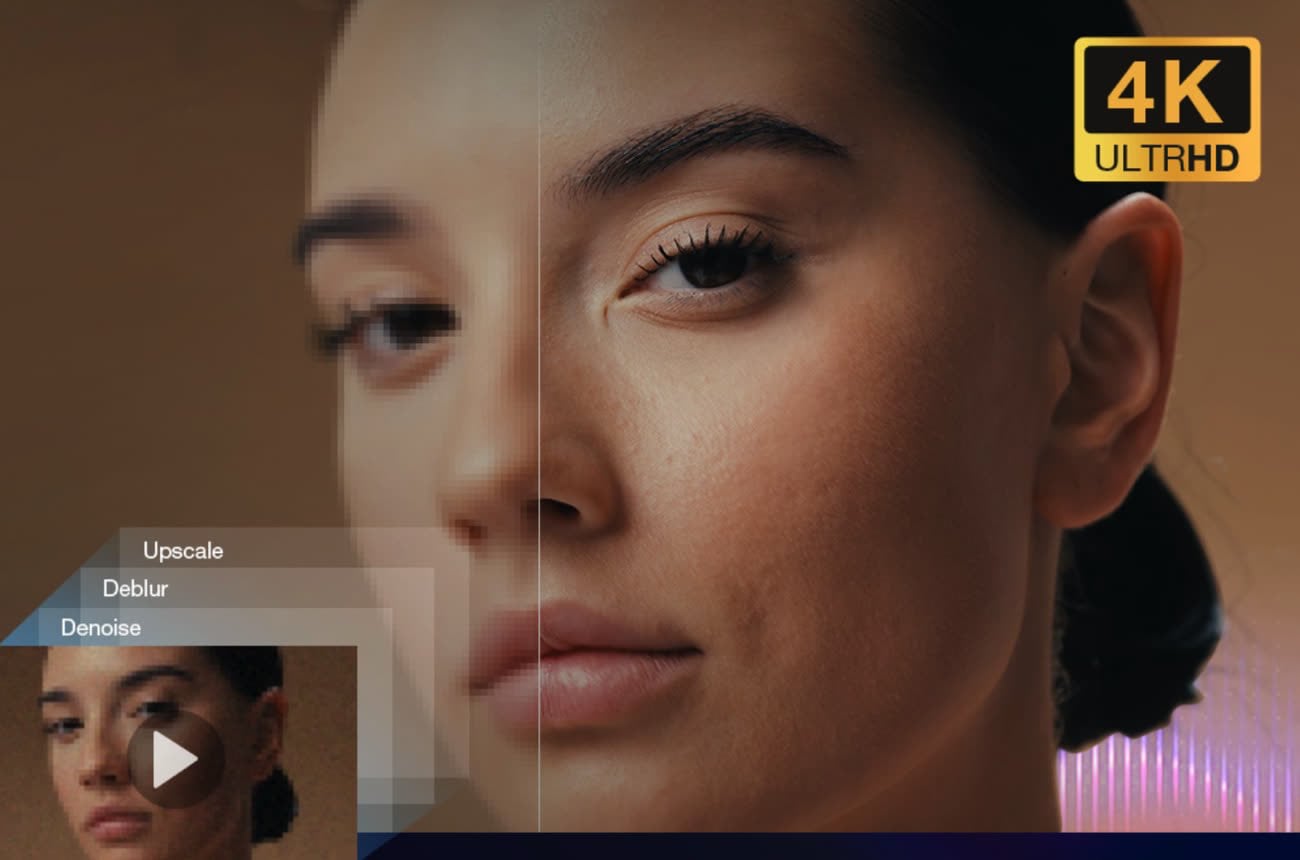

L’ajout de la date et de l’heure en temps réel vient colmater cette fissure apparente, comme rappelé par TheVerge. Tout à coup, le chatbot peut répondre à « on est quel jour ? » sans partir en vol plané. Il peut vous aider à organiser votre soirée sans confondre hier, aujourd’hui et demain. Techniquement, ce n’est qu’un signal de plus qu’on lui injecte. Symboliquement, c’est autre chose : on ne discute plus seulement avec un modèle statistique, mais avec un système branché sur un flux, même minuscule, de réalité. Au final, sans ce petit ajout qui paraît insignifiant, pas de Siri vous aidant à organiser tous vos rendez-vous, vos trajets, vos appels... rien de ce que propose la démonstration de la WWDC 2024 depuis supprimée par Apple n’est possible sans un repère temporel exact dans l’IA, chose qui n’était pas vraiment implémentée jusqu’à récemment.

Un anniversaire très chargé, la bascule à l’OLED et Gemini sous le capot : la semaine Apple

Ce petit branchement ouvre des portes très banales, donc essentielles. La to‑do list du matin, le mail à envoyer « avant ce soir », le rappel pour ne pas rater le train de 18 h 12 : tout ce qui suppose un minimum de synchronisation avec le temps devient soudain crédible. Avant, le modèle simulait la compréhension de ces contraintes ; maintenant, il peut les ancrer dans une horloge commune avec l’utilisateur. Le gain n’est pas spectaculaire comme une démo vidéo, mais il change la texture du quotidien: moins de réponses hors‑sol, moins de dialogues où l’on se surprend à expliquer le calendrier à son « assistant ».

Évidemment, ce réveil temporel a ses limites. Connaître l’heure ne donne pas magiquement accès au monde. Savoir qu’il est 21 h 35 ne dit rien de l’état d’une élection en cours ou de la météo dehors. Le risque, c’est que la précision sur le temps donne l’illusion d’une précision sur tout le reste. Si le chatbot sait que l’on est jeudi soir, pourquoi ne saurait‑il pas aussi ce qui vient de se passer « à l’instant » ? La tentation de surinterpréter cette petite capacité est forte, alors qu’elle repose toujours sur la même mécanique: un modèle doué pour la langue, pas pour la perception.

L’intégration de Gemini à Siri pourrait changer la donne pour les utilisateurs des services Google

Ce qui se joue derrière cette mise à jour, c’est le contrat implicite entre l’IA et son utilisateur. Pendant des années, le discours officiel expliquait qu’un modèle était « figé » à une date de coupe de données, comme un livre dont on connaît la dernière page. En lui donnant accès à l’heure, puis à d’autres signaux, on fabrique peu à peu une créature hybride : un texte figé, augmenté par des bribes de présent. L’assistant devient moins un oracle enfermé dans ses archives qu’un logiciel qui improvise à partir d’un décor mis à jour en temps réel, et peut venir en aide à son utilisateur en proposant des solutions adaptées à l’instant « t ».

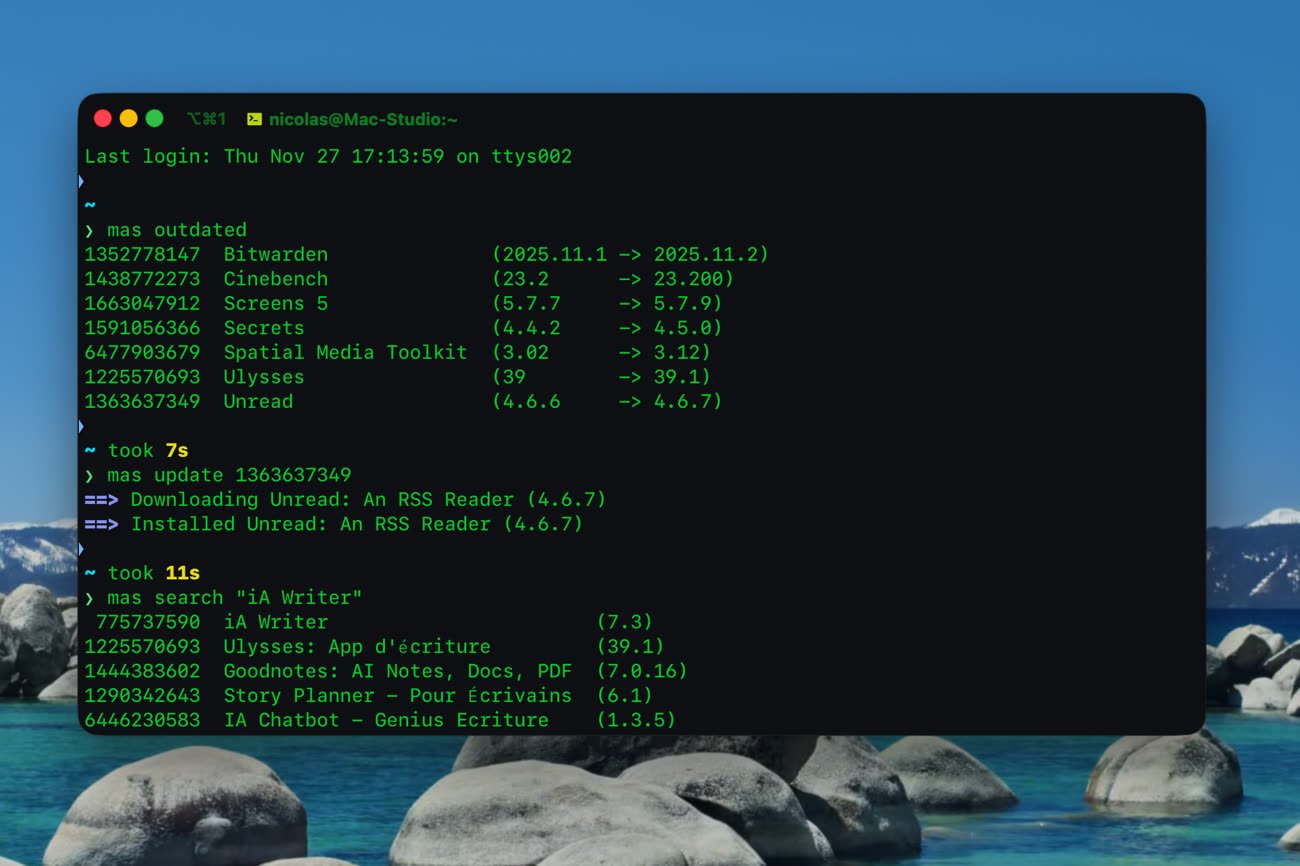

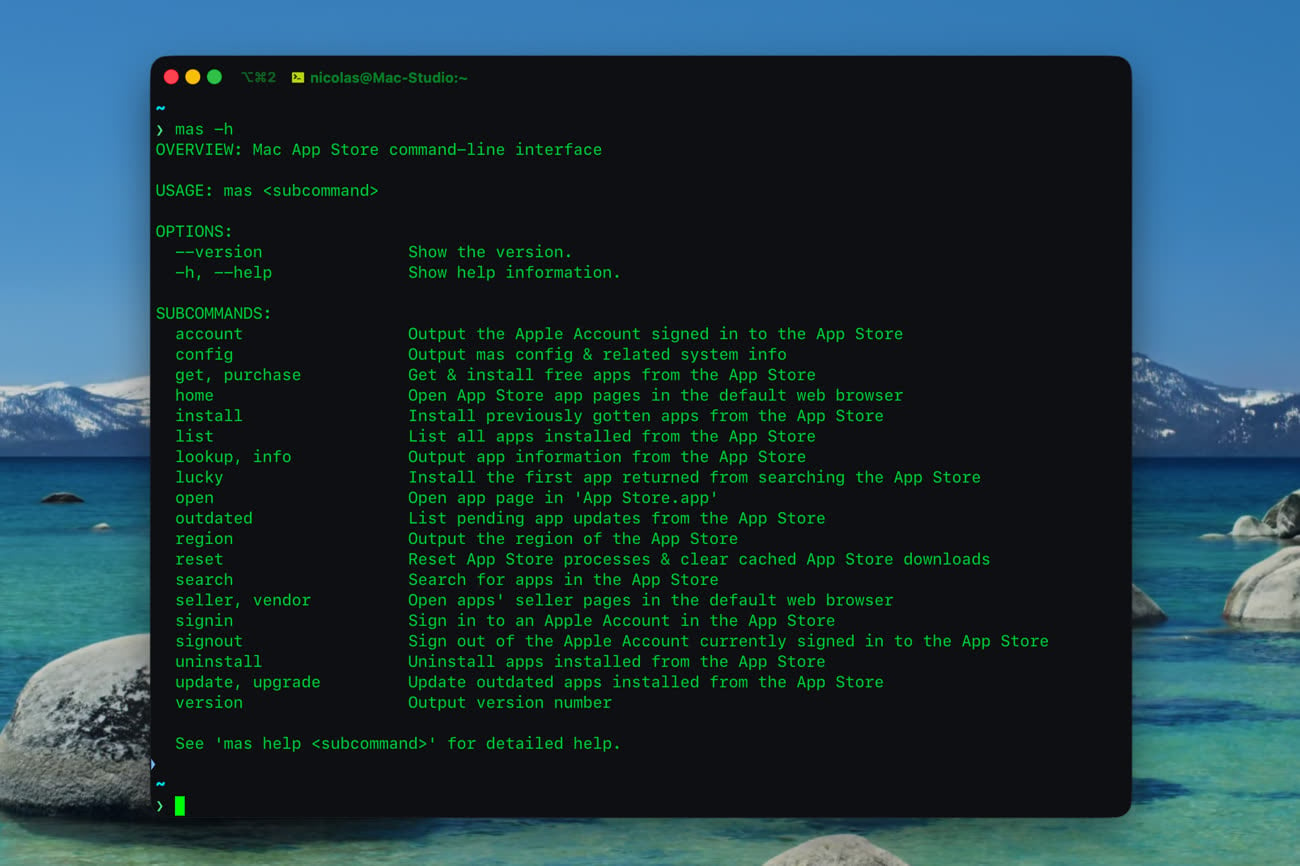

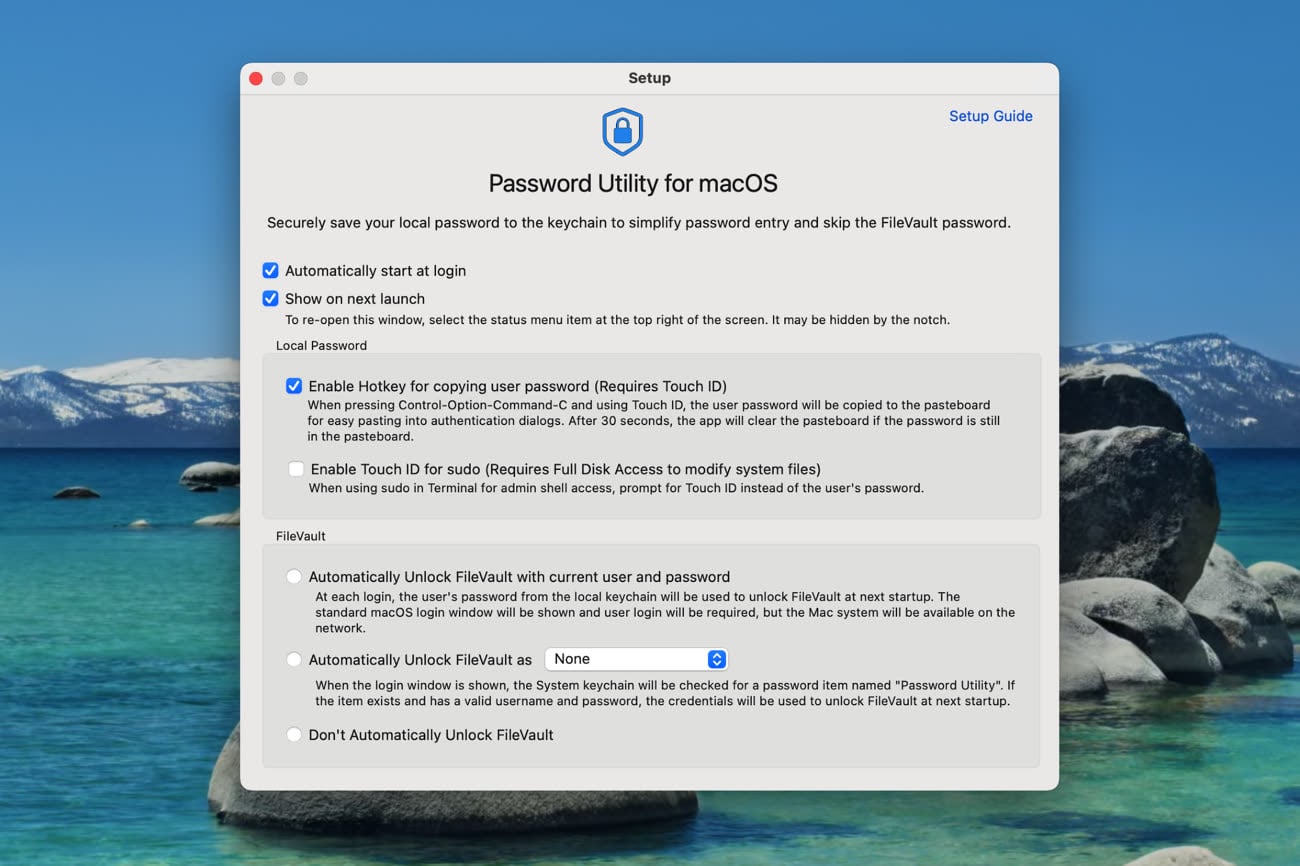

Preuve de la complexité de la chose, Google dans les pages de programmation liées à Gemini conseille fortement aux développeurs de rechercher l’heure système locale, plutôt que de la récupérer en interne sur les serveurs du LLM. Procéder ainsi limite les erreurs temporelles dues à des interprétations erronées du LLM, en allant chercher l’information sûre sur des serveurs ou dans des fonctions qui sont faites précisément pour une chose et une seule : donner l’heure exacte.

On peut se réjouir de ce mouvement : pour une fois, la nouveauté ne tient pas à un score de benchmark, mais à quelque chose de concret pour les gens qui n’ont jamais prononcé le mot « paramètre ». On peut aussi y voir un avant‑goût de ce qui attend l’IA grand public : des modèles reliés à l’heure, puis au calendrier, puis au compte bancaire, puis aux appareils domestiques, jusqu’à ce qu’il devienne difficile de dire où s’arrête la simple commodité et où commence la délégation massive. Pour l’instant, ChatGPT sait seulement que le temps passe. C’est déjà beaucoup, parce que c’est exactement ce que les plateformes passent leur temps à oublier, et probablement ce qui rend si difficile la création de ce Siri omniscient qu’Apple a vanté un peu trop vite dans sa présentation il y a un an et demi.